Con su creciente cuota de mercado, WordPress ha sido — y sigue siendo — el CMS más popular para crear, gestionar y desarrollar sitios web.

Sin embargo, WordPress representa sólo una fracción del desarrollo realizado en la web. ¿Qué pasa con todos los desarrolladores que no utilizan WordPress? Ellos también crean, dirigen y gestionan aplicaciones web para su empresa, sus clientes o ellos mismos.

En Kinsta, hemos trabajado con miles de desarrolladores y cientos de agencias cuyos clientes tienen proyectos construidos con WordPress. Muchos de ellos también tienen proyectos que no están impulsados por el famoso CMS.

Hasta hoy, Kinsta se centraba en la creación de soluciones de alojamiento de WordPress administradas — lo que significaba que los clientes (y sus propios clientes) no podían aprovechar las ventajas de nuestra plataforma para proyectos que no fueran de WordPress y alojar todos los proyectos bajo «un mismo techo.» Esto hacía su trabajo más difícil y menos eficiente.

Así que empezamos a buscar formas de hacerles la vida más fácil.

Cuantos más comentarios recibíamos y más hablábamos con nuestros clientes y probadores de la versión beta sobre sus proyectos, más nos dábamos cuenta de que nuestros clientes tenían un problema subyacente.

Pero hay un giro argumental: no eran sólo nuestros clientes.

Nos dimos cuenta de que este punto de dolor lo experimentan casi todos los desarrolladores, equipos de DevOps y agencias que gestionan proyectos web. Todos luchan con él y están ansiosos por encontrar una solución mejor.

Los Desarrolladores No Deberían Perder el Tiempo Preocupándose por el Alojamiento; Deberían Centrarse en el Desarrollo

¿Cuál es el problema?

La falta de simplicidad en una plataforma de alojamiento en la nube.

Los desarrolladores quieren enviar sus aplicaciones rápidamente. Los desarrolladores necesitan una plataforma que les permita tener todo en un solo lugar, bajo un mismo techo.

Una plataforma que sea sencilla, clara y fácil de usar, de manera que no limite el trabajo de desarrollo a una sola tecnología, framework o biblioteca.

Una plataforma que sea fácil de aprender y utilizar desde el primer día, sin necesidad de cursos especiales o certificaciones específicas de la plataforma.

Una plataforma con un modelo de precios sencillo y transparente. (¿Has intentado alguna vez entender los precios de AWS? ¡Desafiante!)

Sabíamos que la arquitectura en contenedores de Kinsta nos permitiría abordar estas necesidades y ofrecer la plataforma y las herramientas para que los desarrolladores hagan su mejor trabajo.

Además, sabíamos que teníamos:

- Más de 8 años de experiencia en el sector del alojamiento

- Soporte inigualable

- Desarrolladores y equipos de ingeniería con talento capaces de resolver cualquier problema técnico

- Equipos de DevOps que son insuperables cuando se trata de orquestar, gestionar y escalar nuestra plataforma de alojamiento

Por eso hemos construido nuestras nuevas y mejoradas soluciones de alojamiento sobre la misma plataforma que hace que nuestros servicios de WordPress sean tan potentes. Ahora, tras más de un año de duro trabajo en el que han participado más de 320 Kinstanianos, más de 750 beta testers e innumerables iteraciones, lo hemos puesto a disposición del público.

Presentamos las Soluciones de Alojamiento de Aplicaciones y Bases de Datos

La visión de Kinsta es cambiar el status quo. Lo hacemos a través de nuestro firme compromiso de ofrecer la mejor experiencia a los desarrolladores:

Evolucionamos constantemente para ofrecer herramientas y servicios líderes en el sector para el desarrollador moderno. Estamos comprometidos con la mejor experiencia para los desarrolladores y las empresas, construyendo para el rendimiento y la facilidad de uso.

Al añadir nuevos servicios a nuestra oferta, los desarrolladores y los equipos de DevOps de todas las formas y tamaños tienen ahora una plétora de soluciones de alojamiento entre las que elegir para sus aplicaciones, bases de datos, servicios y sitios de WordPress, con más flexibilidad que nunca.

En concreto, Kinsta ofrece ahora:

- Alojamiento Administrado de WordPress

- Alojamiento de Aplicaciones — ¡Nuevo!

- Alojamiento de Bases de Datos — ¡Nuevo!

Veamos con más detalle cada uno de ellos.

Alojamiento Administrado de WordPress (En Pocas Palabras)

Con la ayuda de Google Cloud Platform y su Red de Niveles Premium, hemos creado un servicio de alojamiento gestionado de WordPress que proporciona a más de 25.000 empresas y 100.000 sitios web todo lo que necesitan para seguir funcionando y creciendo.

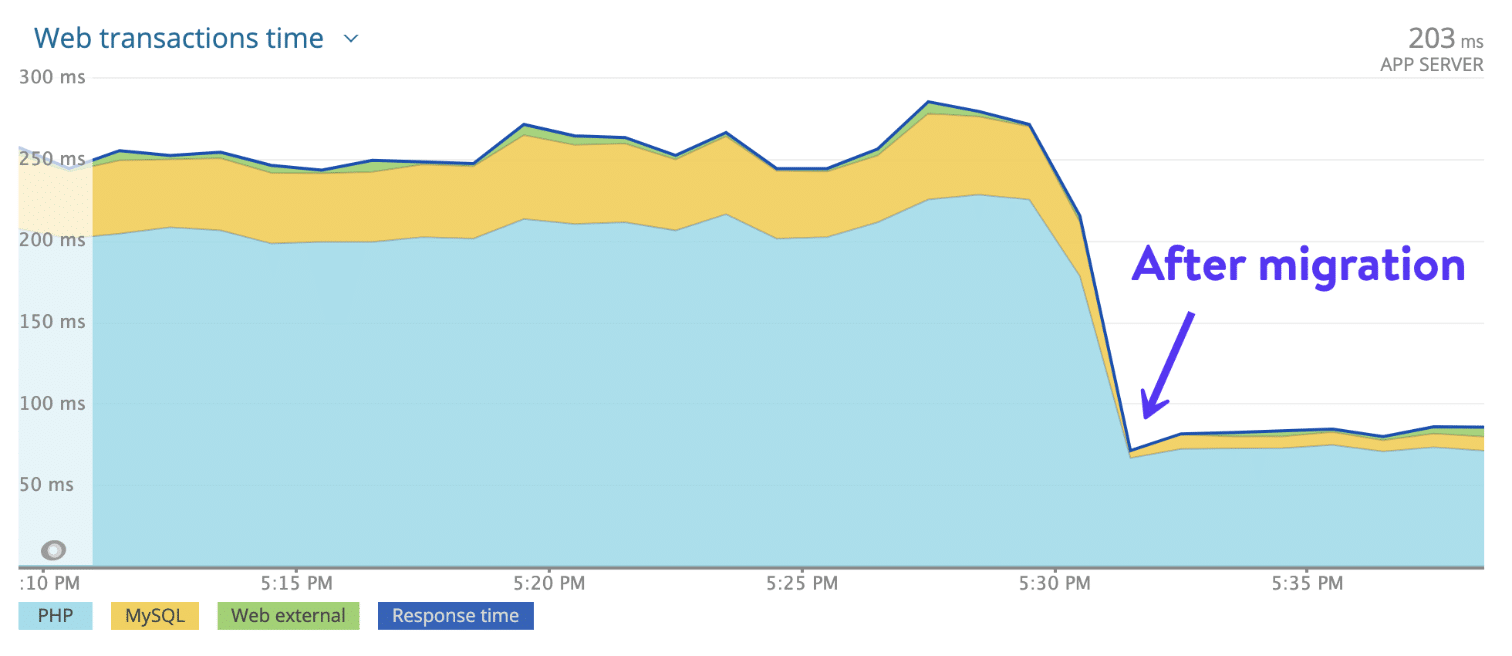

Gracias al uso de las CPUs de gama más alta y a la disponibilidad global de las máquinas virtuales C2 optimizadas para el cálculo de Google, a los 27 centros de datos disponibles y a la rapidísima red de distribución de contenidos (CDN) de Kinsta con 300 PoPs para servir contenido estático y dinámico a una audiencia distribuida por todo el mundo, los clientes que migran de cualquier alojamiento a Kinsta notan una media de un 20% de tiempos de carga más rápidos casi al instante.

Pero las ventajas no acaban ahí.

Gracias a las copias de seguridad automáticas, MyKinsta (nuestro panel de control personalizado y fácil de usar para la gestión del sitio), la herramienta de supervisión de aplicaciones integrada y al cortafuegos de nivel empresarial y la protección contra DDoS de Cloudflare, nuestra solución de alojamiento administrado de WordPress ayuda a los administradores y desarrolladores de sitios a dormir tranquilos sabiendo que sus sitios están seguros.

También saben que Kinsta les ahorra horas de trabajo cada mes. Menos tiempo dedicado a tareas repetitivas pero críticas significa menos gastos generales y menos costes de mantenimiento para tu empresa.

¿Tu negocio funciona con WordPress? ¿Eres un desarrollador de WordPress y buscas un alojamiento con herramientas que te ayuden a agilizar tu trabajo? Echa un vistazo a nuestras soluciones de Alojamiento Administrado de WordPress.

Alojamiento de Aplicaciones (En Pocas Palabras)

El desarrollo web está viviendo un momento interesante que demuestra lo articulado, matizado y complejo que es este mundo hoy en día. Nuestra nueva solución de Alojamiento de Aplicaciones simplifica el trabajo de los desarrolladores web modernos.

Lo simplificamos liberándote de la configuración de contenedores, la gestión de servidores, la preocupación por el sistema operativo, la gestión de copias de seguridad, la instalación de certificados SSL y la adición de dominios personalizados — todo lo que podría impedirte centrarte exclusivamente en el desarrollo.

Hemos construido una plataforma de desarrollo diseñada para ayudarte a poner tus aplicaciones a disposición de los usuarios lo más rápidamente posible.

El alojamiento de aplicaciones de Kinsta es lo que el mercado suele denominar Plataforma como Servicio (PaaS), con herramientas que hacen que el despliegue de tus aplicaciones desde servicios de alojamiento de código como GitHub sea rápido y fácil, y con capacidad para ejecutarlas sin problemas en un entorno optimizado y construido para escalar.

Cómo Desplegar una Aplicación en Kinsta

Nuestros ingenieros y gestores de producto se han centrado en construir un proceso racionalizado para tus despliegues. El proceso sólo requiere 3 pasos:

- Conéctate a tu cuenta de GitHub y elige un repositorio

- Despliega tu aplicación automática (en cada confirmación) o manualmente

- Construye, escala y ejecuta tus procesos por separado

¡Es así de fácil!

No tienes que preocuparte de configurar las imágenes de los contenedores, porque detectamos y desplegamos automáticamente las aplicaciones creadas en esta cada vez más larga lista de lenguajes o frameworks:

- Node.js

- PHP

- Django

- Rails

- Java

- Scala

- Go

(Nota: Estamos elaborando una lista de repositorios básicos de «Hello World» que puedes forkear y desplegar en Kinsta para dar una vuelta al servicio.)

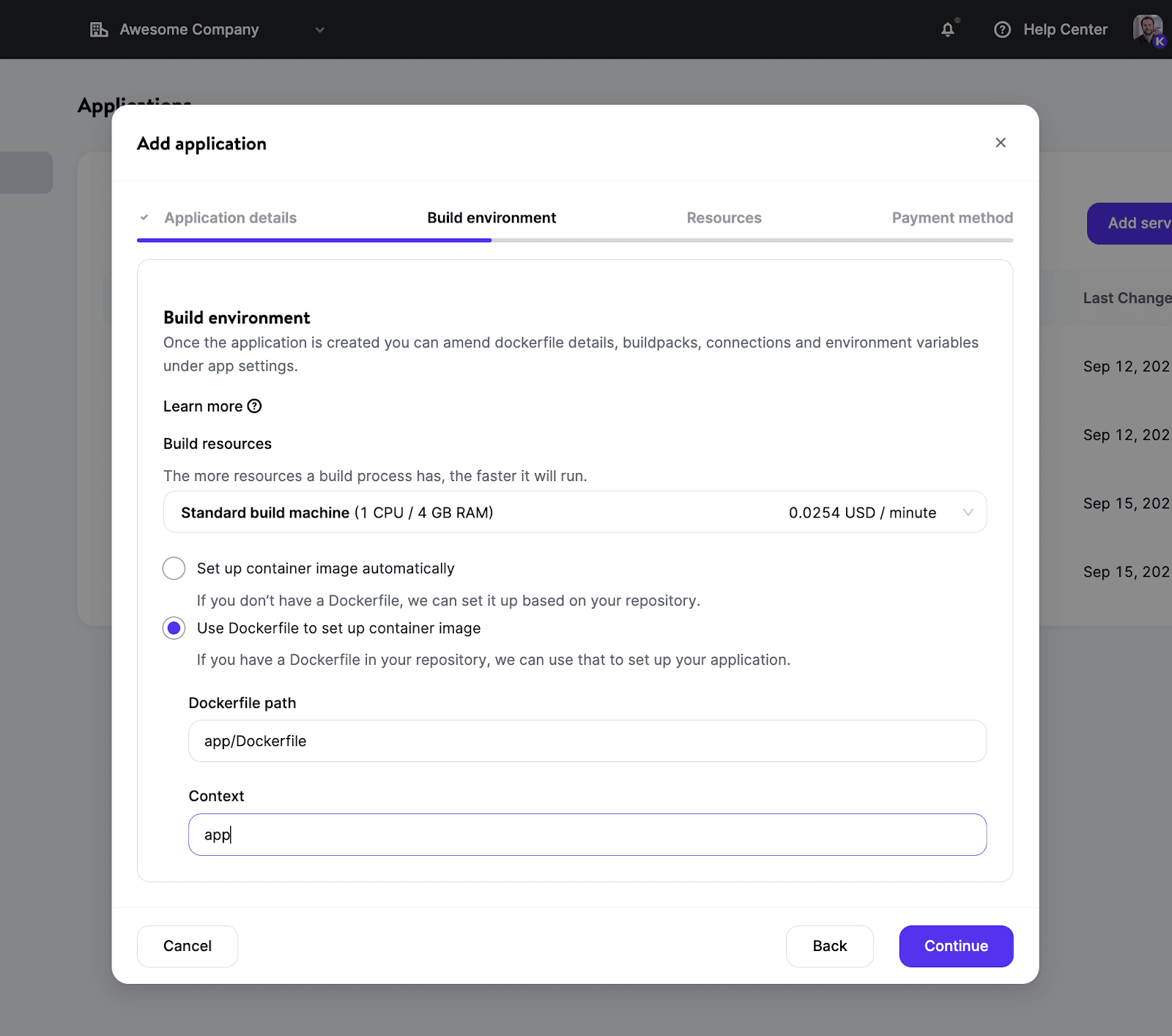

Si prefieres tener más control con una imagen Docker personalizada, puedes utilizar tu propio Dockerfile en el repositorio. Esto te permitirá utilizar casi cualquier lenguaje/framework y no te limitará a los soportados por nuestros Buildpacks actuales.

Una vez configurado tu entorno de compilación, tendrás muchas opciones para elegir el tamaño de los recursos (gracias a los diferentes tipos de pods) que se ajusten a tus necesidades y definir el número de instancias para una mejor escalabilidad.

Para conocer en profundidad todas las características, asegúrate de leer nuestra documentación sobre Alojamiento de Aplicaciones.

Potentes Analíticas para Supervisar tus Aplicaciones

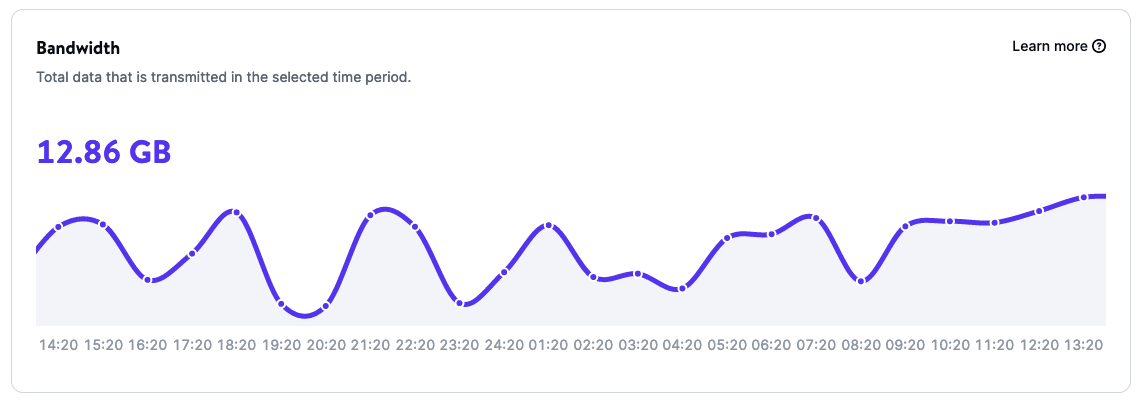

Gracias a las páginas de Analíticas de tus aplicaciones, puedes obtener informes sobre el uso de las mismas que incluyen:

- Ancho de banda

- Tiempo de construcción

- Tiempo de ejecución

- Uso de la CPU

- Uso de la memoria

¿Qué Pasa con los Precios?

El alojamiento de aplicaciones ofrece opciones basadas en recursos, lo que significa que se te cobrará exclusivamente por tu uso y nada más. Y los primeros 20 dólares corren de nuestra cuenta, tanto para los clientes nuevos como para los existentes.

Infórmate sobre el Alojamiento de Aplicaciones en Kinsta y despliega tu primera aplicación en uno de nuestros 24 centros de datos.

Alojamiento de Bases de Datos (En Pocas Palabras)

Las bases de datos son un componente clave de muchos proyectos web. Aunque hay aplicaciones que no necesitan una, la gran mayoría requiere una base de datos.

Gracias a la solución de Alojamiento de Bases de Datos de Kinsta, puedes configurar una base de datos con sólo unos clics, y puedes conectarte a tu base de datos con una aplicación alojada en Kinsta o con un servicio externo.

Actualmente soportamos diferentes tipos de bases de datos, para las que puedes seleccionar la versión que mejor se adapte a las necesidades de tu proyecto. En concreto, puedes alojar:

- MySQL

- MariaDB

- Redis

- PostgreSQL

¡Y estamos trabajando para añadir más en un futuro próximo!

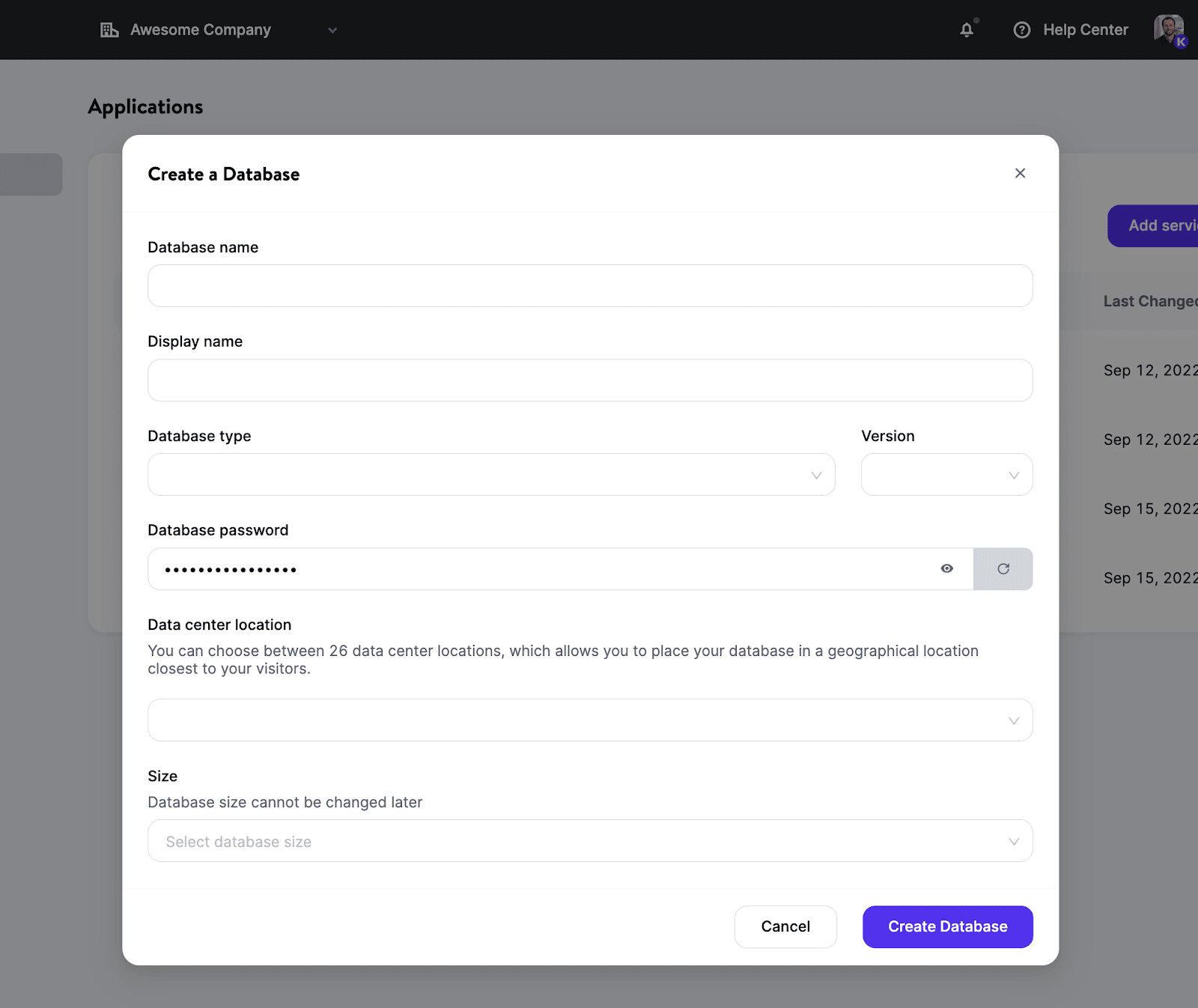

Cómo Desplegar una Base de Datos en Kinsta

Puedes configurar una nueva base de datos y tenerla disponible en cuestión de minutos. No tendrás que gestionar servidores, manejar clusters y contenedores, ni preocuparte de otras tareas de las que suele encargarse DevOps.

El proceso es el siguiente:

- Selecciona el tipo de base de datos y la versión que prefieras.

- Elige una ubicación de despliegue de entre las 24 ubicaciones de centros de datos actualmente disponibles.

- Configura los recursos para tu base de datos.

Voilà: Ahora tienes una base de datos recién creada y en contenedores (¡sin recursos compartidos!) para tus proyectos.

Si creas una conexión interna entre tu aplicación y tu base de datos, ambas vivirán en el mismo clúster y se comunicarán a través de una conexión segura, lo que proporciona un mejor rendimiento que las conexiones externas.

¡Además, no se te cobrará por el tráfico interno, ya que las peticiones permanecen dentro de la misma red!

Para más información, no dejes de leer nuestra documentación sobre el Alojamiento de Bases de Datos.

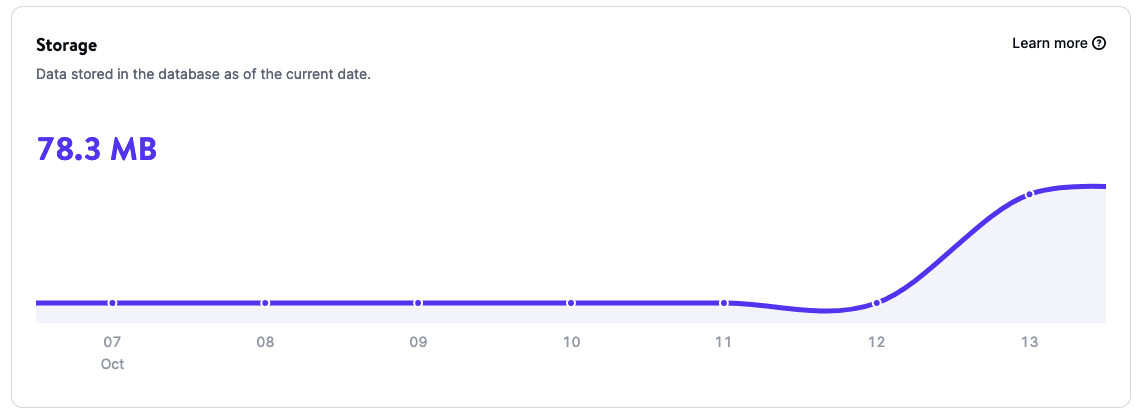

Potentes Analíticas para Controlar tu Base de Datos

Gracias a la Analítica de Bases de Datos, puedes obtener información sobre los datos de uso de tu base de datos, incluyendo:

- Almacenamiento

- Tiempo de ejecución

- Uso de la CPU

- Uso de memoria

¿Y los Precios?

Al igual que el Alojamiento de Aplicaciones, el Alojamiento de Bases de Datos ofrece un sistema de facturación por uso que te cobra en función del tamaño y el tiempo de ejecución de tu base de datos.

Obtén más información sobre el Alojamiento de Bases de Datos en Kinsta y despliega tu primera base de datos en uno de nuestros 24 centros de datos. No lo olvides: obtienes 20$ de descuento en tu primer mes.

¿Qué es lo Siguiente?

Esto es sólo el principio de la nueva era de Kinsta. Nuestros equipos de desarrollo e ingeniería están trabajando duro en nuevas funciones, corrigiendo errores e iterando escuchando atentamente los comentarios que has compartido.

Algunas de las nuevas soluciones en las que estamos trabajando son el alojamiento de sitios estáticos, el aprendizaje automático, las aplicaciones en la nube y la Función como Servicio en el edge — por nombrar solo algunas de las cosas más interesantes de nuestra hoja de ruta. Además, seguiremos centrándonos en mejorar aún más nuestras soluciones administradas para WordPress y en perfeccionarlas con el lanzamiento de nuevas funciones, como Edge Caching, que reduce el tiempo necesario para servir el HTML de WordPress en caché ¡en más de un 50% de media!

Son tiempos estupendos para trabajar como desarrollador, ¡y no podríamos estar más entusiasmados con lo que se avecina en Kinsta!

Resumen

Al ampliar las soluciones de alojamiento de Kinsta, estamos enriqueciendo las formas de apoyar a las empresas y a los desarrolladores, independientemente de la tecnología con la que trabajen. Como ha resumido el presidente del Consejo de Administración de Kinsta:

Estamos construyendo una plataforma en la que los desarrolladores pueden encontrar todo lo que necesitan para ejecutar un servicio web con facilidad, para que puedan centrarse en crear y compartir su mejor trabajo con el mundo.

Para celebrar este nuevo capítulo de la historia de Kinsta, todo el mundo — clientes nuevos y existentes — pueden probar nuestro Alojamiento de Aplicaciones y Alojamiento de Bases de Datos con 20$ de descuento en tu primer mes.

Bienvenido al nuevo Kinsta — la plataforma construida para que los desarrolladores modernos conviertan sus ideas en aplicaciones reales y escalables de la forma que siempre has imaginado.

Simple, rápido, con todo en un solo lugar.

¡Gracias a todos nuestros increíbles clientes por confiarnos su negocio y apoyarnos en este viaje!