Mais tráfego deveria significar mais sucesso, mas, na prática, muitas vezes não é assim. Muitos sites veem o número de visitas crescer enquanto conversões, engajamento e receita permanecem estáveis, deixando as equipes se perguntando por que o “crescimento” não parece crescimento de verdade.

Uma das razões é que nem todo tráfego representa pessoas reais. A atividade automatizada agora representa uma grande parte da web moderna. De fato, o relatório Imperva Bad Bot Report de 2025 constatou que sistemas automatizados representaram 51% de todo o tráfego web em 2024, o que significa que bots geraram coletivamente mais solicitações do que visitantes humanos pela primeira vez em uma década.

Quando o tráfego automatizado se mistura aos relatórios de Análises, a contagem bruta de visitas deixa de ser uma medida confiável do interesse ou da demanda real do público.

Este artigo explica como diferenciar visitantes reais do site, automações úteis e atividades maliciosas de bots.

O que é, de fato, o tráfego de bots

Tráfego de bots refere-se a solicitações feitas por softwares automatizados, em vez de por um humano usando um navegador. Esses programas enviam solicitações para páginas web, imagens, scripts ou APIs da mesma forma que o navegador de um visitante faria, mas a atividade ocorre sem interação humana direta.

Do ponto de vista técnico, o servidor geralmente vê o mesmo tipo de requisição. A diferença está em como a requisição é gerada e como ela se comporta ao longo do tempo.

A automação não é incomum nem inerentemente prejudicial. Grande parte da internet depende de sistemas automatizados que rastreiam sites continuamente, verificam tempo de atividade, validam desempenho ou recuperam dados para serviços legítimos. Mecanismos de pesquisa dependem de bots para descobrir e indexar novos conteúdos, ferramentas de monitoramento testam regularmente a disponibilidade, e várias integrações consultam APIs para manter aplicativos sincronizadas.

É importante destacar que a palavra “bot” descreve como o tráfego é gerado, não o motivo de sua existência. Alguns sistemas automatizados contribuem para visibilidade e segurança, enquanto outros tentam explorar vulnerabilidades, extrair conteúdo ou sobrecarregar a infraestrutura. Como a intenção varia amplamente, identificar e classificar o comportamento dos bots é muito mais útil do que tratar todo o tráfego automatizado como uma única categoria.

Os três tipos de tráfego que chegam ao seu site

O tráfego de sites costuma ser tratado como uma divisão simples entre “humano” e “bot”, mas, na prática, a maioria das solicitações se enquadra em três categorias: visitantes reais, bots úteis e bots maliciosos. Entender essa distinção facilita a interpretação de análises, o gerenciamento de recursos e a aplicação de controles de segurança adequados sem prejudicar atividades legítimas.

Como mencionado anteriormente, o relatório Imperva Bad Bot Report apontou que o tráfego automatizado representou mais da metade de todas as solicitações web globalmente, com uma parte significativa classificada como automação benéfica ou atividade maliciosa de bots. Quando essas diferentes fontes são combinadas, o volume de tráfego por si só oferece pouca visibilidade sobre a demanda ou o engajamento real dos usuários.

O objetivo não é bloquear tudo o que parece automatizado, mas identificar quais solicitações vêm de pessoas reais, quais dão suporte à funcionalidade e à visibilidade do site e quais geram risco ou carga desnecessária.

Analisar padrões de comportamento, características das solicitações e fontes de tráfego pode fornecer a clareza necessária para permitir automações benéficas, proteger contra atividades maliciosas e avaliar o desempenho com base em dados que refletem o comportamento real dos usuários.

Visitantes reais: como é o tráfego humano

O tráfego humano tende a seguir padrões irregulares e imprevisíveis. Visitantes reais navegam pelos sites de maneiras variadas. Eles clicam em diferentes caminhos de navegação, pausam em determinadas páginas, rolam em diferentes profundidades e passam tempos variados antes de realizar a próxima ação. Mesmo quando múltiplos visitantes chegam por meio da mesma campanha ou região, seu comportamento raramente segue sequências idênticas.

Sessões de usuários reais também incluem padrões de interação realistas. Ações como buscas no site, envio de formulários, reprodução de mídia, login em contas ou atividades de eCommerce geralmente ocorrem em progressões lógicas, e não em intervalos perfeitamente cronometrados ou repetitivos. O tempo entre solicitações varia naturalmente, refletindo como as pessoas leem, pensam e decidem o que fazer em seguida.

Com o MyKinsta, você pode ver rapidamente quais páginas estão recebendo mais tráfego, de forma imediata:

A diversidade de dispositivos é outro forte indicativo de tráfego humano. Visitantes reais acessam usando uma ampla variedade de navegadores, sistemas operacionais, velocidades de conexão e tamanhos de tela. Mesmo em tráfego concentrado geograficamente, há variações entre dispositivos e configurações, criando uma distribuição que raramente é uniforme.

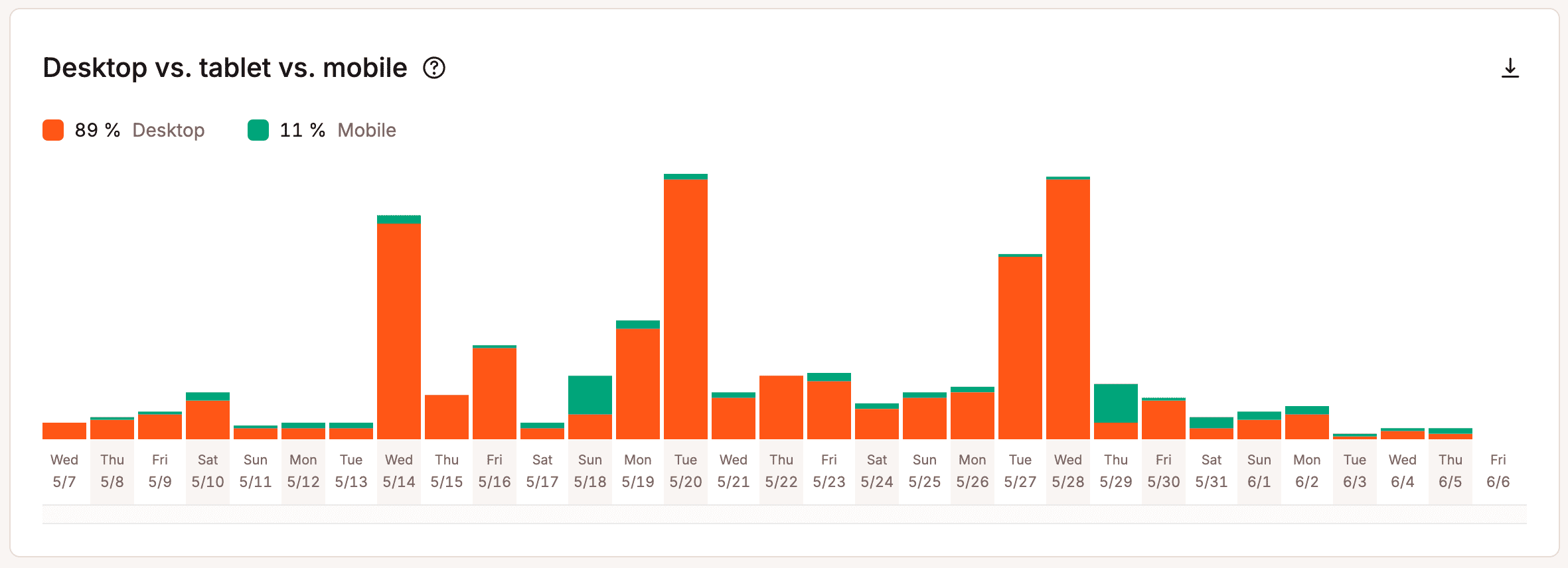

O MyKinsta também fornece informações sobre o uso por dispositivo:

Ao mesmo tempo, identificar o tráfego humano nem sempre é simples. Proteções de privacidade, bloqueadores de anúncios, camadas de cache e ambientes de rede compartilhados podem ocultar certos sinais ou fazer com que diferentes usuários pareçam semelhantes no nível da infraestrutura.

Por esse motivo, a classificação de tráfego funciona melhor quando múltiplos indicadores, incluindo padrões de comportamento, características de sessão, diversidade de dispositivos e sinais de interação, são avaliados em conjunto, em vez de depender de uma única métrica.

Bots úteis: automação que dá suporte ao seu site

Nem todo tráfego automatizado é algo que você deve bloquear. Muitos bots desempenham um papel essencial para manter seu site visível, monitorado e funcionando corretamente.

Crawlers de mecanismos de pesquisa

Este é um dos exemplos mais importantes. Esses bots fazem solicitações sistemáticas às páginas para descobrir novos conteúdos, avaliar mudanças e atualizar índices de pesquisa.

Seu comportamento costuma ser estruturado e previsível, seguindo links de forma metódica e respeitando as diretrizes de rastreamento definidas no robots.txt. Impedir o acesso desses crawlers pode reduzir a visibilidade nos mecanismos de pesquisa e atrasar a indexação de novas páginas.

Monitores de tempo de atividade e serviços de teste

Outras automações legítimas são focadas em monitoramento e saúde operacional. Ferramentas de monitoramento de tempo de atividade, verificadores de desempenho e serviços de testes sintéticos enviam requisições em intervalos regulares para confirmar disponibilidade, medir tempos de carregamento e detectar falhas precocemente.

Ferramentas de SEO e validação

Da mesma forma, ferramentas de SEO, acessibilidade e validação analisam páginas para identificar problemas técnicos, links quebrados ou questões de conformidade que poderiam passar despercebidas.

Bots úteis geralmente deixam sua presença clara. Eles costumam se identificar por meio de user agents consistentes, operam dentro de limites definidos de solicitações e seguem políticas públicas de rastreamento.

Como esses sistemas dão suporte à indexação, observabilidade e integrações, bloqueá-los sem análise pode interromper fluxos de monitoramento, reduzir a descoberta do site ou quebrar serviços que dependem de solicitações automatizadas programadas.

Como esses sistemas suportam indexação, observabilidade e integrações, bloqueá-los sem revisão pode interromper os fluxos de trabalho de monitoramento, reduzir a capacidade de descoberta ou interromper serviços que dependem de solicitações automatizadas programadas.

Bots maliciosos: tráfego que gera risco ou desperdício

Bots maliciosos são sistemas automatizados projetados para explorar sites, extrair dados em escala ou consumir recursos de infraestrutura sem fornecer qualquer valor legítimo. Ao contrário das automações úteis, esses bots geralmente tentam ocultar sua identidade, ignoram regras de rastreamento e geram padrões de requisição projetados para contornar proteções básicas.

Bots de credential stuffing e força bruta

Essas são algumas das ameaças mais comuns. Esses sistemas atacam repetidamente endpoints de login, testando grandes listas de nomes de usuário e senhas roubadas em rápida sucessão, na tentativa de obter acesso não autorizado. Mesmo quando não têm sucesso, o volume de solicitações pode aumentar a carga do servidor e reduzir os tempos de resposta para usuários legítimos.

Scanners de vulnerabilidade e scrapers

Outras automações maliciosas focam em descoberta e exploração. Scanners de vulnerabilidade verificam diretórios conhecidos, arquivos de configuração e endpoints de software em busca de componentes desatualizados ou configurações incorretas que possam ser exploradas. Bots de scraping agressivos também podem requisitar grandes volumes de páginas ou arquivos de mídia para copiar conteúdo e republicá-lo em outros lugares, consumindo largura de banda e capacidade da infraestrutura no processo.

Ataques DDoS

Alguns ataques têm como objetivo apenas causar interrupções, e não obter acesso. Campanhas de inundação de tráfego e negação de serviço tentam sobrecarregar servidores ou camadas de aplicação com picos contínuos de requisições, degradando o desempenho ou tornando os serviços temporariamente indisponíveis.

Além do impacto imediato no desempenho, o tráfego de bots maliciosos pode distorcer os dados de análises e prejudicar a experiência de visitantes reais se não for gerenciado.

Como diferenciar humanos, bots úteis e bots maliciosos

Diferenciar visitantes reais, automações úteis e bots maliciosos depende menos de um único identificador e mais do reconhecimento de padrões consistentes de comportamento em múltiplos sinais.

Quando avaliados em conjunto, esses indicadores facilitam determinar se o tráfego reflete atividade humana, automação legítima ou requisições potencialmente abusivas.

Frequência e tempo das solicitações

Os visitantes humanos geram solicitações em intervalos irregulares enquanto leem, navegam e interagem, enquanto sistemas automatizados tendem a solicitar páginas em velocidades altamente consistentes ou em rajadas rápidas que seriam difíceis de replicar manualmente. Taxas extremamente altas de requisições de uma única origem ou intervalos perfeitamente cronometrados geralmente indicam atividade automatizada.

User agents

Bots legítimos geralmente se identificam de forma clara e consistente, enquanto bots maliciosos frequentemente rotacionam ou falsificam user agents na tentativa de parecer humanos. Comparar as declarações de user agent com o comportamento observado ajuda a revelar inconsistências que indicam automação.

Reputação de IP e origem de rede

Tráfego proveniente de redes conhecidas de hospedagem em nuvem, serviços de proxy ou endereços previamente sinalizados pode indicar sistemas automatizados em vez de usuários reais. Bancos de dados de reputação e ferramentas de segurança classificam essas redes com base em atividades anteriores e ajudam a identificar fontes suspeitas com mais velocidade.

Padrões de distribuição geográfica

Aumentos repentinos de tráfego vindos de regiões inesperadas, especialmente quando combinados com comportamentos idênticos de requisição, podem indicar atividade coordenada de bots em vez de crescimento real de audiência.

Respeito ao robots.txt e aos limites de rastreamento

Quando você observa esse comportamento, é um forte indicativo de automação legítima. Bots úteis geralmente seguem as políticas de rastreamento publicadas e operam dentro de limites razoáveis de requisições, enquanto bots maliciosos normalmente ignoram essas diretrizes e continuam requisitando caminhos ou arquivos restritos.

Como nenhum desses sinais isoladamente fornece uma resposta completa, a classificação eficaz depende da análise conjunta de vários indicadores. Com o tempo, esses padrões combinados criam uma visão confiável sobre se o tráfego representa usuários reais, automação benéfica ou atividade que exige filtragem ou mitigação.

Onde analisar o tráfego de bots

Entender a atividade de bots exige visibilidade em várias camadas da sua stack de hospedagem e entrega. Nenhuma ferramenta isolada mostra o panorama completo, por isso a combinação de análises, registros e dashboards de segurança gera informações muito mais confiáveis. Veja cada um deles:

Plataformas de análises oferecem uma visão geral de alto nível

Picos de tráfego sem aumento correspondente de engajamento, anomalias geográficas repentinas ou distribuições incomuns de dispositivos frequentemente indicam atividade automatizada. Embora ferramentas de análises nem sempre classifiquem bots com precisão, elas ajudam a identificar padrões que indicam a necessidade de uma análise mais detalhada. Até plugins simples como o Jetpack podem ajudar nesse processo.

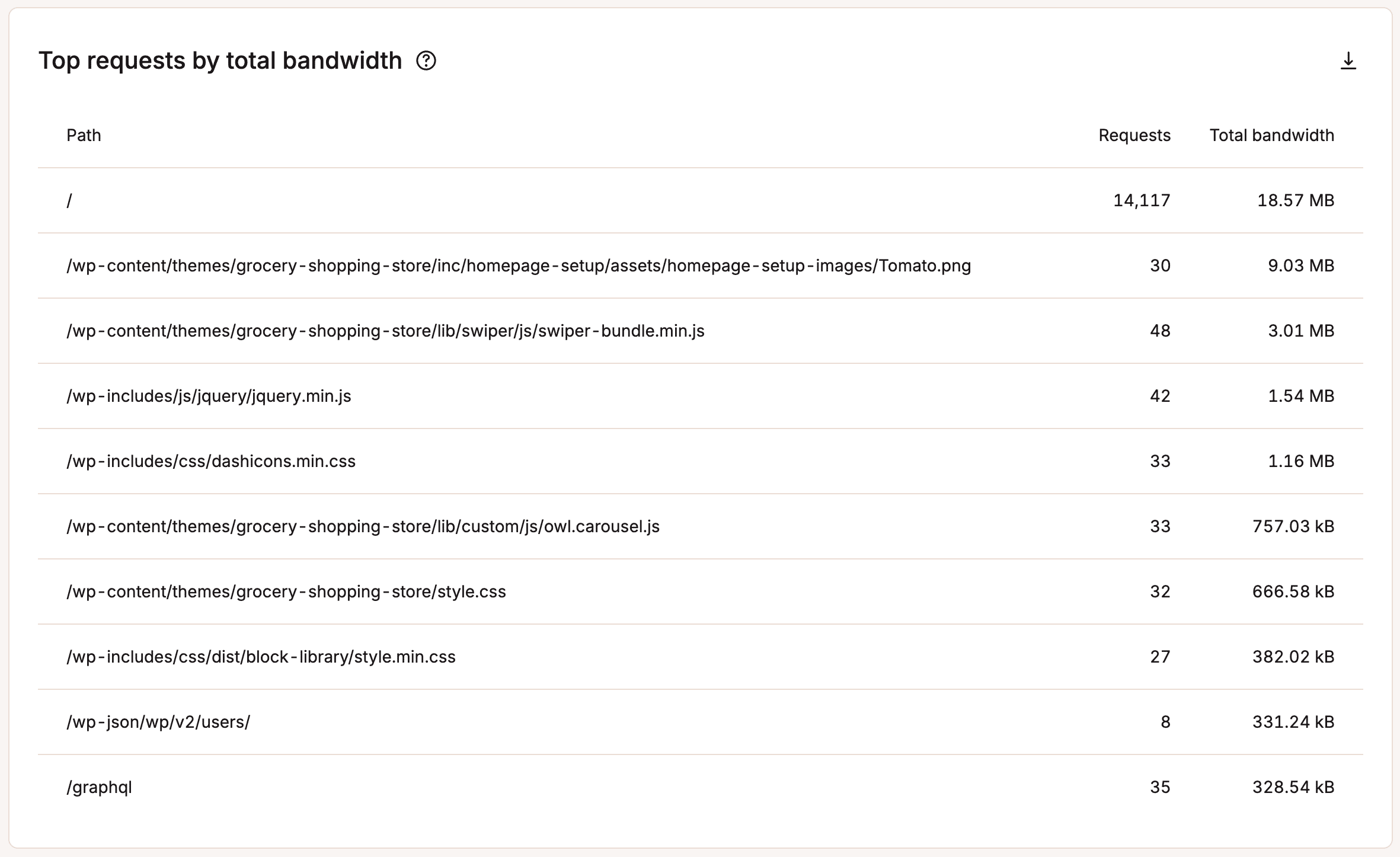

Registros de servidor e de acesso oferecem a visão mais detalhada do comportamento das solicitações

Os registros revelam frequência de solicitações, códigos de resposta, user agents, endereços IP e caminhos acessados, permitindo identificar padrões repetitivos de varredura, tentativas de ataque a login ou comportamento de scraping que passariam despercebidos em dados analíticos agregados.

Os painéis de controle de CDN adicionam outra camada de visibilidade

Os painéis de CDN mostram padrões de tráfego na edge da rede antes que as requisições cheguem ao seu servidor de origem. Esses painéis frequentemente destacam picos de tráfego, anomalias regionais ou requisições automatizadas repetidas que são filtradas ou limitadas antes de chegar à origem. Isso ajuda a detectar ataques muito mais cedo.

Firewalls e ferramentas WAF fornecem informações em tempo real

Firewalls permitem visualizar requisições bloqueadas, desafiadas ou suspeitas em tempo real. A análise dos registros do firewall pode revelar quais fontes de tráfego estão acionando regras de segurança e se ajustes são necessários para reduzir falsos positivos ou reforçar proteções.

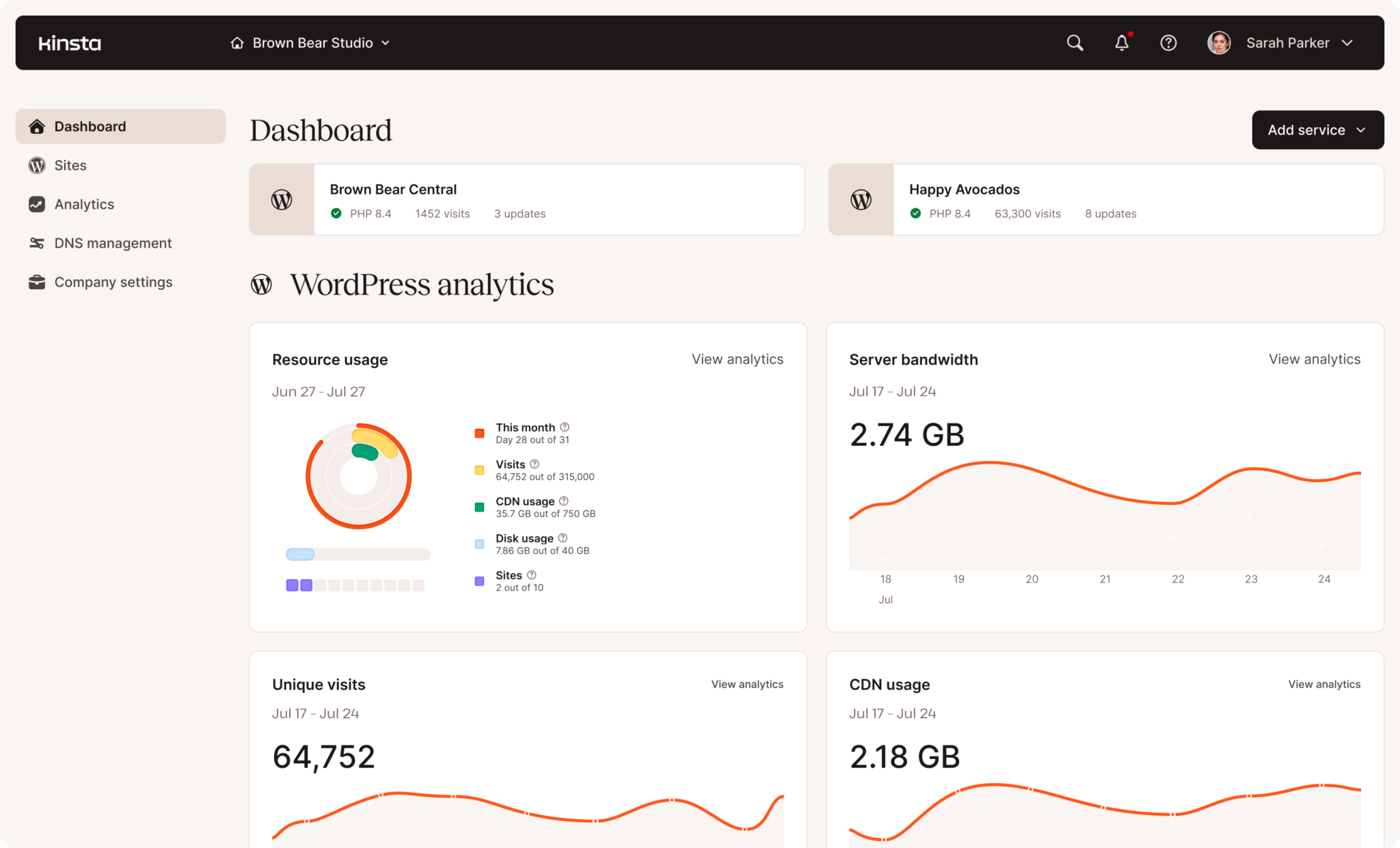

As plataformas de hospedagem gerenciada simplificam o processo ao consolidar várias dessas fontes de dados. Por exemplo, os ambientes que integram a análise de nível do CDN, o monitoramento de firewall e os registros de acesso em um único painel facilitam a correlação do comportamento suspeito entre as camadas.

Provedores de hospedagem como a Kinsta também destacam a análise de tráfego, o monitoramento de desempenho e os dados de eventos de segurança diretamente em seu painel, o MyKinsta. Isso significa que você e sua equipe podem analisar o comportamento de bots sem ter que depender de várias ferramentas externas.

Como o tráfego de bots distorce a análise e a tomada de decisões

Quando solicitações automatizadas se misturam a visitas legítimas, os dados analíticos começam a refletir atividades que não representam o interesse real do público. As visualizações de página e as contagens de sessões podem parecer aumentar constantemente, embora o engajamento real, as conversões ou a receita permaneçam inalterados. Sem separar o tráfego automatizado das sessões humanas, você pode interpretar números de tráfego inflados como crescimento e tomar decisões estratégicas com base em sinais enganosos.

Métricas de engajamento tornam-se especialmente pouco confiáveis. Bots frequentemente geram sessões com duração extremamente curta, saídas imediatas ou requisições repetidas de páginas, o que pode inflar ou distorcer métricas como taxa de rejeição e tempo na página. Em alguns casos, bots de scraping requisitam repetidamente páginas específicas, criando a falsa impressão de que determinado conteúdo tem desempenho superior ao que realmente apresenta para usuários reais.

Dados geográficos, de dispositivos e de origem de tráfego também podem ser distorcidos. O tráfego automatizado frequentemente se origina de centros de dados, redes proxy ou regiões concentradas que não correspondem à base real de usuários do site. Quando essas sessões são incluídas nos relatórios, equipes de marketing podem investir nas regiões erradas, otimizar para tendências incorretas de dispositivos ou interpretar mal o desempenho de campanhas.

Com o tempo, essas imprecisões afetam relatórios, planejamento de desempenho, decisões de escalabilidade de infraestrutura e investimentos em marketing. Todos esses aspectos dependem de dados de tráfego para prever demanda. Se uma parte significativa desse tráfego for automatizada, empresas correm o risco de superestimar o crescimento, alocar recursos de forma ineficiente ou ignorar comportamentos reais de usuários que exigem atenção.

Boas práticas para gerenciar diferentes tipos de tráfego

Gerenciar o tráfego moderno da web exige uma abordagem equilibrada que proteja o desempenho do site sem interferir em automações legítimas ou usuários reais. Em vez de tentar bloquear tudo o que parece automatizado, o objetivo é aplicar políticas que correspondam ao comportamento e à intenção de cada tipo de tráfego.

Priorize a experiência do usuário real

Otimize desempenho, disponibilidade e acessibilidade para que visitantes legítimos acessem o conteúdo de forma rápida e confiável, mesmo durante picos de tráfego. Tempos de carregamento rápidos, infraestrutura estável e cache resiliente ajudam a garantir que usuários reais não sejam impactados quando o tráfego automatizado aumenta. Você pode otimizar o desempenho diretamente na Kinsta utilizando a API da Kinsta com o Google PageSpeed Insights.

Permita e monitore automações úteis

Crawlers de mecanismos de pesquisa, monitores de tempo de atividade e ferramentas de validação devem ser explicitamente permitidos quando apropriado, garantindo que indexação, monitoramento e integrações continuem funcionando corretamente. Revisar periodicamente o comportamento de rastreamento ajuda a confirmar que bots legítimos operam dentro de limites aceitáveis.

Aplique proteções baseadas em comportamento para tráfego malicioso

Limites de solicitações, desafios de segurança e regras de bloqueio direcionadas funcionam melhor quando acionados por padrões suspeitos de requisição, e não por suposições estáticas sobre intervalos de IP ou user agents. Controles baseados em comportamento reduzem a chance de bloquear serviços legítimos enquanto ainda mitigam atividades abusivas.

Revise e ajuste políticas regularmente

Os padrões de tráfego mudam conforme sites crescem, campanhas são lançadas e novos sistemas automatizados interagem com o conteúdo. Revisões periódicas de regras de firewall, limites de requisição e alertas de monitoramento ajudam a garantir que as proteções estejam alinhadas com o comportamento atual do tráfego, evitando decisões baseadas em suposições desatualizadas.

Use informações de origem de tráfego para tomar decisões melhores

O volume de tráfego por si só raramente conta toda a história sobre o desempenho de um site. Quando visitas humanas, automações úteis e atividades maliciosas de bots são separadas, os dados de análises se tornam muito mais relevantes e acionáveis.

Uma segmentação limpa do tráfego permite que equipes meçam o crescimento real de audiência, entendam padrões reais de engajamento e avaliem o desempenho de marketing sem que ruídos automatizados distorçam os resultados.

Uma classificação mais precisa do tráfego também melhora decisões operacionais. Planejamento de desempenho, escalabilidade de infraestrutura e estratégias de segurança se tornam mais fáceis de alinhar com a demanda real quando requisições automatizadas são medidas e gerenciadas separadamente.

Se o seu ambiente de hospedagem atual oferece pouca visibilidade sobre as fontes de tráfego, pode ser interessante avaliar plataformas que oferecem inteligência de tráfego mais avançada e ferramentas integradas de gerenciamento de bots. Ambientes gerenciados como a Kinsta oferecem análises integrados, proteções de firewall e insights de tráfego na edge que ajudam a diferenciar usuários reais de atividades automatizadas.

Os planos mais recentes da Kinsta baseados em largura de banda também adicionam flexibilidade ao alinhar melhor os recursos de hospedagem com o consumo real de tráfego. Se tiver dúvidas, você pode falar com nossa equipe de suporte a qualquer momento.