通常、サイトのトラフィックが増えれば成果も上がるはずですが、実際にはそうならないことも少なくなりません。多くのサイトで訪問数が増加している一方で、コンバージョンやエンゲージメント、収益が伸びず、「成長しているはずなのに実感が伴わない」と感じるケースもあります。

その理由のひとつとして挙げられるのは、すべてのトラフィックが実際のユーザーによるものとは限らないことです。現在のウェブでは、自動アクセスが大きな割合を占めており、2025年のImperva Bad Bot Reportによると、2024年のウェブトラフィックの51%は自動化されたシステムによるもので、過去10年で初めてボットによるリクエスト数が人間の訪問を上回りました。

このような自動化トラフィックが分析データに混在すると、単純な訪問数だけでは、実際のユーザーの関心や需要を正確に把握することが難しくなります。

そこで今回は、実際のユーザーによるアクセス、有益な自動化トラフィック、そして有害なボット活動を見分ける方法をご紹介します。

ボットトラフィックとは?

ボットトラフィックとは、私たち人間がブラウザを使って行うアクセスではなく、自動化されたソフトウェアによって送信されるリクエストを意味します。これらのプログラムは、通常のユーザーのブラウザと同じように、ウェブページや画像、スクリプト、APIに対してリクエストを送信しますが、その動作は人の操作を介さずに行われます。

技術的に見ると、サーバー側には同じ種類のリクエストとして認識されることが多々あり、違いとしては、そのリクエストがどのように生成され、時間の経過とともにどのように振る舞うかにあります。

自動化自体は特別なものでも、有害なものでもありません。実際、インターネットの多くは自動化されたシステムによって支えられており、サイトのクロール、稼働状況の監視、パフォーマンスの検証、正当なサービスのためのデータ取得などを継続的に行っています。検索エンジンはボットを使って新たなコンテンツを発見・インデックスし、監視ツールは定期的にサイトの可用性をチェックします。また、さまざまな連携機能がAPIを通じてデータを取得し、アプリケーション間の同期を保っています。

重要なのは、「ボット」という言葉はトラフィックの目的ではなく、生成方法を表しているという点です。自動化されたシステムの中には、可視性やセキュリティを支えるものもあれば、脆弱性の悪用やコンテンツのスクレイピング、インフラへの負荷を狙うものもあります。このように目的は大きく異なるため、すべてのボットトラフィックを一括りにするのではなく、その挙動を見極めて分類することが鍵になります。

サイトに流入するトラフィックの3つの種類

サイトのトラフィックは「人間」か「ボット」かという単純な区分で語られることが多いですが、実際には多くのリクエストが、実際のユーザー、有益なボット、そして有害なボットという3つのカテゴリに分類できます。この違いを理解することで、分析データの解釈やリソース管理、正当なアクセスを妨げないセキュリティ対策の実施がしやすくなります。

冒頭で触れたImperva Bad Bot Reportによれば、世界全体のウェブトラフィックの半数以上が自動化されたリクエストであり、その中には有益な自動化と悪意のあるボット活動の両方が含まれています。これらが混在している場合、単純なトラフィック量だけでは、実際のユーザーの需要やエンゲージメントを正確に把握することはできません。

ここで重視すべきなのは、自動化されたトラフィックを一律にブロックすることではなく、どのリクエストが実際のユーザーによるものか、どれがサイトの機能や可視性を支えているのか、そしてどれがリスクや不要な負荷を生んでいるのかを見極めることです。

行動パターンやリクエストの特徴、トラフィックの発生元を分析することで、有益な自動化は許可しつつ、有害な活動からサイトを保護し、実際のユーザー行動を反映したデータに基づいてパフォーマンスを評価できるようになります。

実際のユーザー:人間によるトラフィックの特徴

人間によるトラフィックは、不規則で予測しにくい動きをする傾向があります。実際のユーザーはサイト内をさまざまな経路で移動し、異なるナビゲーションをクリックし、特定のページで立ち止まり、スクロールの深さも人それぞれです。また、次の行動に移るまでの滞在時間にもばらつきがあります。同じキャンペーンや地域から訪れたユーザーであっても、完全に同じ行動パターンになることはほぼありません。

実際のユーザーセッションには、自然な操作の流れも見られます。サイト内検索、フォーム送信、メディアの再生、アカウントへのログイン、ECでの操作などは、機械的に一定間隔で繰り返されるのではなく、意味のある順序で発生します。リクエスト間の時間にも自然なばらつきがあり、人が読み、考え、次の行動を決めるプロセスが反映されます。

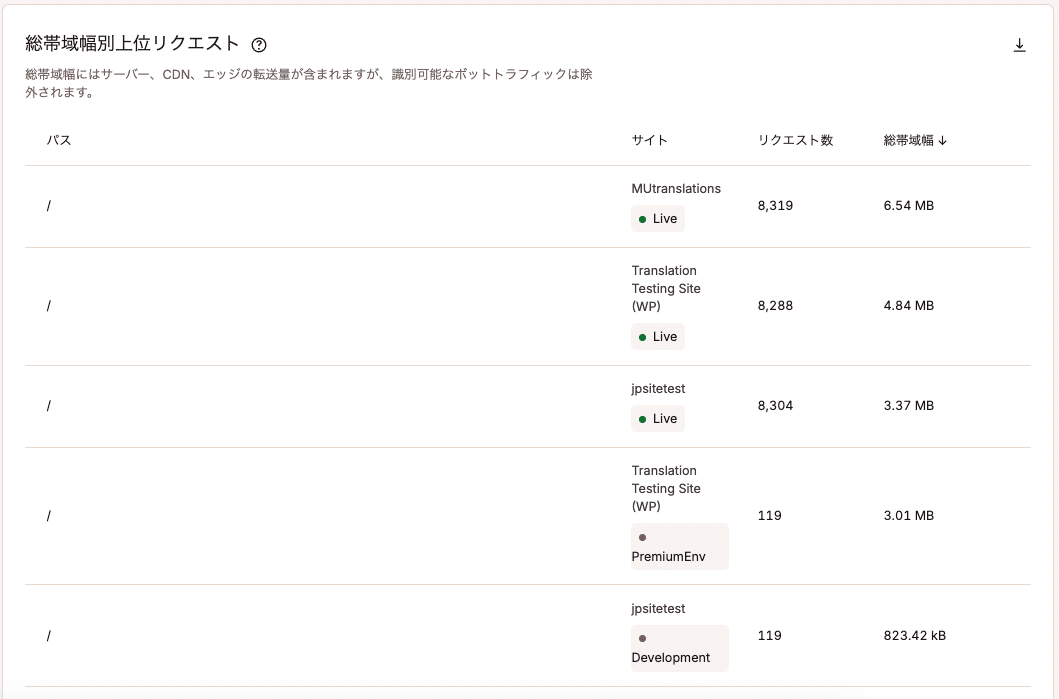

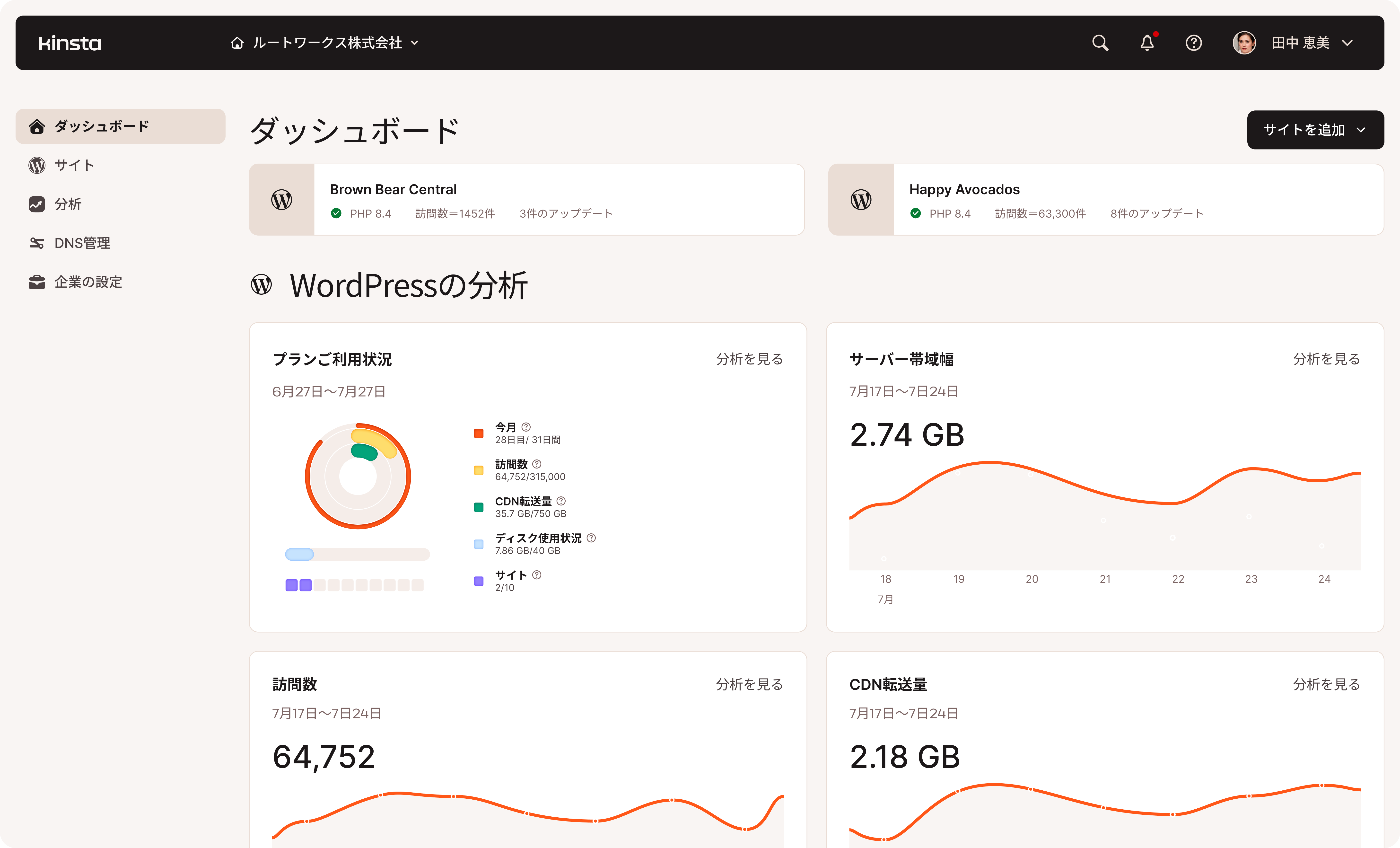

Kinstaの専用コントロールパネル『MyKinsta』では、どのページに多くのトラフィックが集まっているかをひと目で確認できます。

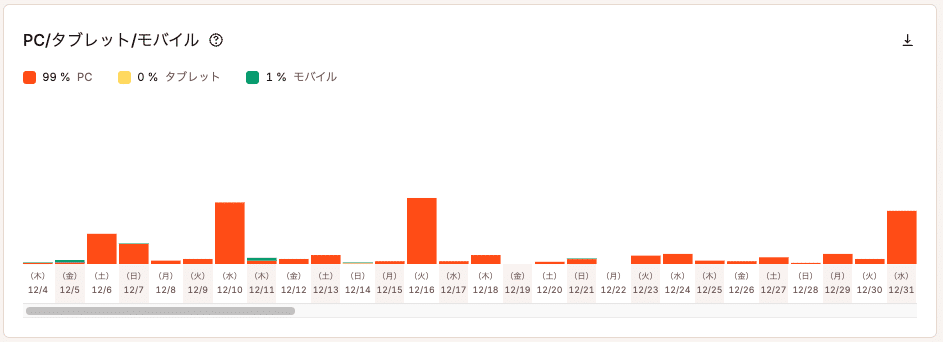

デバイスの多様性も、人間によるトラフィックを見分ける重要な指標のひとつです。実際のユーザーは、さまざまなブラウザ、オペレーティングシステム、通信速度、画面サイズのデバイスからアクセスしています。特定の地域からのアクセスが集中している場合でも、デバイスや設定にはばらつきがあり、均一な分布になることはほとんどありません。

MyKinstaでは、デバイス別のアクセス状況も確認できます。

同時に、人間によるトラフィックを正確に特定することは必ずしも簡単ではありません。プライバシー保護、広告ブロッカー、キャッシュレイヤー、共用ネットワーク環境などにより、一部のシグナルが見えにくくなったり、異なるユーザーがインフラ上では似たように見える場合があります。

そのため、トラフィックの分類は、単一の指標に頼るのではなく、これまでに説明した行動パターン、セッション特性、デバイスの多様性、インタラクションのシグナルなど、複数の要素を組み合わせて評価するのが効果的です。

有益なボット:サイトを支える自動化トラフィックの特徴

すべての自動化トラフィックを遮断すべきというわけではなく、多くのボットは、サイトの可視性や監視、正常な動作を維持するうえで重要な役割を果たしています。

検索エンジンクローラー

最も重要な例のひとつが検索エンジンのクローラーです。このボットはページを体系的に巡回し、新しいコンテンツの発見や変更の評価、検索インデックスの更新を行います。

その挙動は一般的に規則的で予測しやすく、リンクを順にたどりながら、robots.txtで定義されたクロールルールにも従います。これらのクローラーをブロックすると、検索結果での可視性が低下し、新しいページが表示されるまでの時間が遅れる可能性があります。

稼働監視・テストツール

その他の正当な自動化は、監視や運用状態の維持に焦点が当てられています。稼働監視ツール、パフォーマンスチェックツール、シンセティックテストサービスなどは、一定間隔でリクエストを送信し、可用性の確認や読み込み時間の測定、障害の早期検出を行います。

SEO・検証ツール

同様に、SEOツールやアクセシビリティツール、各種検証ツールもページをスキャンし、技術的な問題やリンク切れ、準拠性の問題などを検出します。

有益なボットは通常、その存在を明確に示します。一定のユーザーエージェントを使用し、リクエスト数の制限を守り、公開されているクロールポリシーに従って動作します。

これらのシステムはインデックス作成や監視、各種連携を支えているため、内容を確認せずにブロックすると、監視機能の停止や可視性の低下、定期的な自動処理に依存するサービスの不具合につながる可能性があります。

有害なボット:リスクや無駄を生むトラフィックの特徴

有害なボットは、サイトの脆弱性を悪用したり、大量のデータを取得したり、正当な価値を提供することなくインフラリソースを消費するよう設計された自動化システムです。これらは有益なボットとは異なり、身元を隠そうとしたり、クロールルールを無視したり、基本的な防御を回避するようなリクエストパターンを生成する傾向があります。

クレデンシャルスタッフィング・ブルートフォース攻撃

代表的な脅威のひとつです。これらのシステムはログイン画面を繰り返し攻撃し、流出したユーザー名とパスワードの組み合わせを大量に試行して不正アクセスを狙います。成功しなかった場合でも、リクエスト数の増加によりサーバー負荷が高まり、正規ユーザーの応答速度が低下する可能性があります。

脆弱性スキャナー・スクレイピングボット

他の悪意ある自動化は、調査と悪用を目的としています。脆弱性スキャナーは既知のディレクトリや設定ファイル、ソフトウェアのエンドポイントを探索し、古いコンポーネントや設定ミスを探します。また、攻撃的なスクレイピングボットは大量のページやメディアファイルを取得してコンテンツを複製し、帯域幅やインフラリソースを消費します。

DDoS攻撃

一部の攻撃は、不正アクセスではなくサービスの妨害そのものを目的としています。大量のトラフィック送信やサービス拒否(DoS)攻撃により、継続的なリクエストの急増を引き起こし、サーバーやアプリケーション層に負荷をかけます。その結果、パフォーマンスが低下したり、サービスが一時的に利用できなくなることがあります。

有害なボットトラフィックは、パフォーマンスへの直接的な影響にとどまらず、適切に管理されない場合、分析データを歪めたり、実際のユーザー体験を損なう原因にもなります。

人間・有益なボット・有害なボットの見分け方

実際のユーザー、有益な自動化、有害なボットを見分けるには、単一の識別情報に頼るのではなく、複数のシグナルに共通する一貫した行動パターンを捉えることが重要です。

これらの指標を組み合わせて評価することで、そのトラフィックが人間によるものか、正当な自動化か、あるいは悪意のある可能性があるリクエストなのかを、より判断しやすくなります。

リクエスト頻度とタイミング

人間のユーザーは、ページを読み、スクロールし、ナビゲーションを行う中で、不規則な間隔でリクエストを発生させます。一方、自動化されたシステムは、非常に一定の速度でページをリクエストしたり、人間には再現が難しい短時間の連続アクセス(バースト)を行う傾向があります。単一の発信元から極端に高い頻度でリクエストが送られている場合や、完全に一定の間隔でリクエストが発生している場合は、スクリプトによる自動化の可能性が高いと考えられます。

ユーザーエージェント

正当なボットは通常、自身を明確かつ一貫したユーザーエージェントで識別します。一方、有害なボットは人間に見せかけるために、ユーザーエージェントを頻繁に変更したり、偽装したりする傾向があります。ユーザーエージェントの申告内容と実際の挙動を比較することで、不一致を見つけることができ、自動化されたアクセスであるかどうかを判断する手がかりになります。

IPの信頼性とネットワーク

既知のクラウド環境のネットワークやプロキシサービス、過去に問題が報告されているIPアドレスからのトラフィックは、実際のユーザーではなく自動化されたシステムによる可能性があります。レピュテーションデータベースやセキュリティツールは、過去の活動履歴に基づいてこれらのネットワークを分類し、不審な発信元をより迅速に特定するのに役立ちます。

地理的分布のパターン

想定していない地域からのトラフィックが急増している場合や、同一のリクエストパターンと組み合わさっている場合は、実際のユーザー増加ではなく、組織的なボット活動である可能性があります。

robots.txtやクロール制限の遵守

これが確認できる場合は、正当な自動化である可能性が高い指標となります。有益なボットは通常、公開されているクロールポリシーに従い、適切なリクエスト制限の範囲内で動作します。一方、有害なボットはこれらのルールを無視し、制限されたパスやファイルへのリクエストを継続します。

これらのシグナルは単独では決定的な判断材料にはなりませんが、複数を組み合わせて分析することで、より正確な分類が可能になります。時間の経過とともに、こうしたパターンの積み重ねにより、流入トラフィックが実際のユーザーによるものか、有益な自動化か、あるいはフィルタリングや対策が必要な活動かを、信頼性高く判断できるようになります。

ボットトラフィックを分析する場所

ボットの挙動を理解するには、ホスティングや配信スタックの複数のレイヤーにわたる可視性が必要です。単一のツールですべてを把握することはできないため、分析ツール、ログ、セキュリティダッシュボードを組み合わせることで、より信頼性の高い洞察が得られます。それぞれを見ていきましょう。

分析ツール

エンゲージメントを伴わないトラフィックの急増、予期しない地域からのアクセス、異常なデバイス分布などは、自動化されたトラフィックの兆候であることが多くあります。分析ツールはボットを正確に分類できるとは限りませんが、より詳しい調査が必要なパターンを把握するのに役立ちます。Jetpackのようなシンプルなプラグインでも有効です。

サーバーログとアクセスログ

ログは、リクエスト頻度、レスポンスコード、ユーザーエージェント、IPアドレス、アクセスされたパスなどを明らかにし、繰り返されるスキャンパターンやログイン攻撃、スクレイピングといった挙動を特定するのに役立ちます。これらは、集計された分析データだけでは見えにくい情報です。

CDNの管理画面

CDNの管理画面では、リクエストがオリジンサーバーに到達する前のネットワークエッジでのトラフィックを可視化できます。トラフィックの急増や地域ごとの異常、上流でフィルタリングまたはレート制限された自動リクエストなどを把握でき、攻撃をより早い段階で検知するのに役立ちます。

ファイアウォール(WAF)

ファイアウォールでは、ブロック、確認、または不審と判断されたリクエストをリアルタイムで把握できます。ログを確認することで、どのトラフィックがセキュリティルールに引っかかっているのか、また誤検知の削減や防御強化のために設定を調整すべきかどうかを判断できます。

マネージドサーバーでは、これら複数のデータソースを統合することで分析を簡素化できます。たとえば、CDNレベルの分析、ファイアウォールの監視、アクセスログを単一のダッシュボードに統合することで、レイヤーをまたいだ不審な挙動の相関関係を把握しやすくなります。

Kinstaでは、MyKinsta内でトラフィック分析、パフォーマンス監視、セキュリティイベントをまとめて確認できます。これにより、複数の外部ツールに依存することなく、チーム全体でボットの挙動を効率的に分析できます。

ボットトラフィックが分析データや意思決定に与える影響

自動化されたリクエストが正規の訪問と混在すると、分析データは実際のユーザーの関心を正しく反映しなくなります。ページビューやセッション数は増加しているように見えても、エンゲージメントやコンバージョン、収益が変わらないままという状況が起こり得ます。自動化トラフィックと人間によるアクセスを分けて分析しない場合、膨らんだトラフィック数を成長と誤解し、誤ったシグナルに基づいて意思決定を行ってしまう可能性があります。

特にエンゲージメント指標は影響を受けやすくなります。ボットは、極端に短いセッション時間、即時離脱、同一ページへの繰り返しアクセスなどの挙動を示すことが多く、これにより直帰率やページ滞在時間といった指標が実態とかけ離れた値になることがあります。また、スクレイピングボットが特定のページに繰り返しアクセスすることで、実際よりもそのコンテンツのパフォーマンスが高く見える場合もあります。

地域、デバイス、参照元といったデータも歪む可能性があります。自動化トラフィックは、データセンターやプロキシネットワーク、特定の地域に集中して発生することが多く、実際のユーザー層とは一致しない場合があり。これらがレポートに含まれると、マーケティングチームが誤った地域に投資したり、実態と異なるデバイストレンドに最適化したり、キャンペーンの成果を誤って評価してしまう可能性があります。

こうした不正確さは、長期的にレポーティング、パフォーマンス計画、インフラのスケーリング判断、マーケティング投資に影響を及ぼします。これらはいずれもトラフィック分析に基づいて需要を予測するため、そのトラフィックの多くが自動化されたものである場合、成長を過大評価したり、リソース配分を誤ったり、本来注目すべきユーザー行動を見落とすリスクがあります。

さまざまなトラフィックを管理するためのベストプラクティス

現代のウェブトラフィックを適切に管理するには、正当な自動化や実際のユーザーの利用を妨げることなく、サイトのパフォーマンスを保護するバランスの取れたアプローチが求められます。自動化されているように見えるすべてを単純にブロックするのではなく、それぞれのトラフィックの挙動と目的に応じたポリシーを適用することが重要です。

実際のユーザー体験を優先する

パフォーマンス、可用性、アクセシビリティを最適化し、トラフィックの急増時であっても、正当なユーザーがコンテンツに迅速かつ安定してアクセスできるようにします。高速な読み込み時間、安定したインフラ、耐障害性のあるキャッシュにより、自動化トラフィックが増加しても正規ユーザーに影響が及ばないようにすることができます。Kinstaでは、Google PageSpeed InsightsとKinsta APIを使用して、パフォーマンスを直接最適化することが可能です。

有益な自動化を許可し、監視する

検索エンジンクローラー、稼働監視ツール、検証ツールなどは、インデックス作成や監視、各種連携が正しく機能し続けるよう、適切な範囲で明示的に許可する必要があります。クロールの挙動を定期的に確認することで、正当なボットが適切な範囲内で動作しているかを把握できます。

有害なトラフィックには挙動ベースの対策を適用する

レート制限、セキュリティチャレンジ、対象を絞ったブロックルールは、IPアドレス範囲やユーザーエージェントといった固定的な前提ではなく、不審なリクエストパターンに基づいて適用する場合に最も効果的です。挙動に基づく制御により、正当なサービスを誤ってブロックするリスクを抑えながら、不正な活動を軽減できます。

ポリシーを定期的に見直し、調整する

サイトの成長やキャンペーンの実施、新たな自動化システムの導入に伴い、トラフィックのパターンは変化します。ファイアウォールのルール、レート制限、監視アラートを定期的に見直すことで、過去の前提に依存するのではなく、現在のトラフィックの挙動に適した保護を維持できます。

トラフィックの発生元情報を活用して意思決定を改善しよう

トラフィック量だけでは、サイトの実際のパフォーマンスを十分に把握することはできません。人間によるアクセス、有益な自動化、有害なボット活動を分けて分析することで、データはより意味のあるものとなり、実行可能な洞察が得られます。

トラフィックを適切にセグメント化することで、チームは実際のユーザー増加を正確に測定し、真のエンゲージメントパターンを理解し、自動化によるノイズに影響されることなくマーケティングの成果を評価できるようになります。

より正確なトラフィック分類は、運用面での意思決定の改善にもつながります。パフォーマンス計画、インフラのスケーリング、セキュリティ戦略は、自動化されたリクエストを独立して測定・管理することで、実際の需要により適切に合わせることができます。

現在ご利用のサーバー環境でトラフィックの発生元に関する可視性が十分でない場合は、より高度なトラフィック分析機能や統合されたボット管理ツールを提供するプラットフォームの導入を検討する価値があります。Kinstaのようなマネージド環境では、組み込みの分析機能、ファイアウォール保護、エッジレベルのトラフィック分析により、実際のユーザーと自動化されたアクセスを区別することができます。

昨年新たに導入されたKinstaの帯域幅ベースのプランでは、実際のトラフィック消費量により密接に対応する形でリソースを割り当てるため、柔軟性も向上しています。ご興味がありましたら、カスタマーサポートまでお気軽にお問い合わせください。