Meer verkeer zou meer succes moeten betekenen, maar in de praktijk is dat vaak niet het geval. Veel websites zien het aantal bezoekers stijgen, terwijl conversies, betrokkenheid en omzet op hetzelfde niveau blijven, waardoor teams zich afvragen waarom die ‘groei’ helemaal niet als groei aanvoelt.

Een van de redenen is dat niet al het verkeer van echte mensen komt. Geautomatiseerde activiteit maakt tegenwoordig een groot deel uit van het moderne web. Uit het Imperva Bad Bot Report 2025 bleek zelfs dat geautomatiseerde systemen in 2024 goed waren voor 51% van al het webverkeer, wat betekent dat bots voor het eerst in tien jaar samen meer verzoeken genereerden dan menselijke bezoekers.

Wanneer geautomatiseerd verkeer in analyserapporten terechtkomt, wordt het aantal ruwe bezoeken op zichzelf een onbetrouwbare maatstaf voor de werkelijke interesse of vraag van het publiek.

In dit artikel wordt uitgelegd hoe je onderscheid kunt maken tussen echte websitebezoekers, nuttige automatisering en schadelijke botactiviteit.

Wat botverkeer eigenlijk is

Botverkeer verwijst naar verzoeken die worden gedaan door geautomatiseerde software in plaats van door een mens die een browser gebruikt. Deze programma’s sturen verzoeken naar webpagina’s, afbeeldingen, scripts of API’s op dezelfde manier als de browser van een bezoeker dat zou doen, maar de activiteit vindt plaats zonder directe menselijke interactie.

Vanuit technisch oogpunt ziet de server vaak hetzelfde type verzoek. Het verschil zit hem in hoe het verzoek wordt gegenereerd en hoe het zich in de loop van de tijd gedraagt.

Automatisering is niet ongebruikelijk of per definitie schadelijk. Een groot deel van het internet is afhankelijk van geautomatiseerde systemen die continu websites crawlen, de uptime controleren, de prestaties valideren of gegevens ophalen voor legitieme diensten. Zoekmachines vertrouwen op bots om nieuwe content te ontdekken en te indexeren, monitoringtools testen regelmatig de beschikbaarheid en diverse integraties doen API-verzoeken om applicaties gesynchroniseerd te houden.

Belangrijk is dat het woord ‘bot’ beschrijft hoe het verkeer wordt gegenereerd, niet waarom het bestaat. Sommige geautomatiseerde systemen ondersteunen zichtbaarheid en beveiliging, terwijl andere proberen kwetsbaarheden te misbruiken, content te scrapen of de infrastructuur te overbelasten. Omdat de intentie sterk varieert, is het identificeren en classificeren van botgedrag veel nuttiger dan al het geautomatiseerde verkeer als één categorie te behandelen.

De drie soorten verkeer die je site bezoeken

Websiteverkeer wordt vaak besproken als een simpele scheiding tussen ‘mens’ en ‘bot’, maar in werkelijkheid vallen de meeste verzoeken in drie praktische categorieën: echte bezoekers, nuttige bots en schadelijke bots. Als je dit onderscheid begrijpt, is het makkelijker om analytics te interpreteren, resources te beheren en de juiste beveiligingsmaatregelen toe te passen zonder legitieme activiteiten te verstoren.

Zoals we eerder al zeiden, bleek uit het Imperva Bad Bot Report dat geautomatiseerd verkeer wereldwijd meer dan de helft van alle webverzoeken uitmaakte, waarbij een aanzienlijk deel werd geclassificeerd als nuttige automatisering of kwaadaardige botactiviteit. Als je deze verschillende bronnen samenvoegt, geeft het verkeersvolume op zich weinig inzicht in de echte vraag of betrokkenheid van gebruikers.

Het doel is niet om alles te blokkeren wat geautomatiseerd lijkt, maar om te bepalen welke verzoeken van echte mensen komen, welke de functionaliteit en zichtbaarheid van de site ondersteunen, en welke risico’s of onnodige belasting veroorzaken.

Door gedragspatronen, kenmerken van verzoeken en verkeersbronnen te analyseren, krijg je de duidelijkheid die je nodig hebt om nuttige automatisering toe te staan, je te beschermen tegen schadelijke activiteiten en de prestaties te evalueren aan de hand van gegevens die het echte gebruikersgedrag weerspiegelen.

Echte bezoekers: hoe menselijk verkeer eruitziet

Menselijk verkeer volgt meestal onregelmatige, onvoorspelbare patronen. Echte bezoekers bewegen zich op verschillende manieren door websites. Ze klikken op verschillende navigatiepaden, blijven even hangen op bepaalde pagina’s, scrollen tot verschillende dieptes en besteden wisselende hoeveelheden tijd voordat ze de volgende actie ondernemen. Zelfs als meerdere bezoekers afkomstig zijn van dezelfde campagne of regio, volgt hun gedrag zelden identieke patronen.

Authentieke gebruikerssessies bevatten ook realistische interactiepatronen. Acties zoals zoeken op de site, het invullen van formulieren, het afspelen van media, inloggen op accounts of e-commerce-activiteiten vinden doorgaans plaats in logische vervolgingen in plaats van in perfect getimede of herhaalde intervallen. De timing tussen verzoeken varieert op natuurlijke wijze, wat weerspiegelt hoe mensen lezen, denken en beslissen wat ze vervolgens gaan doen.

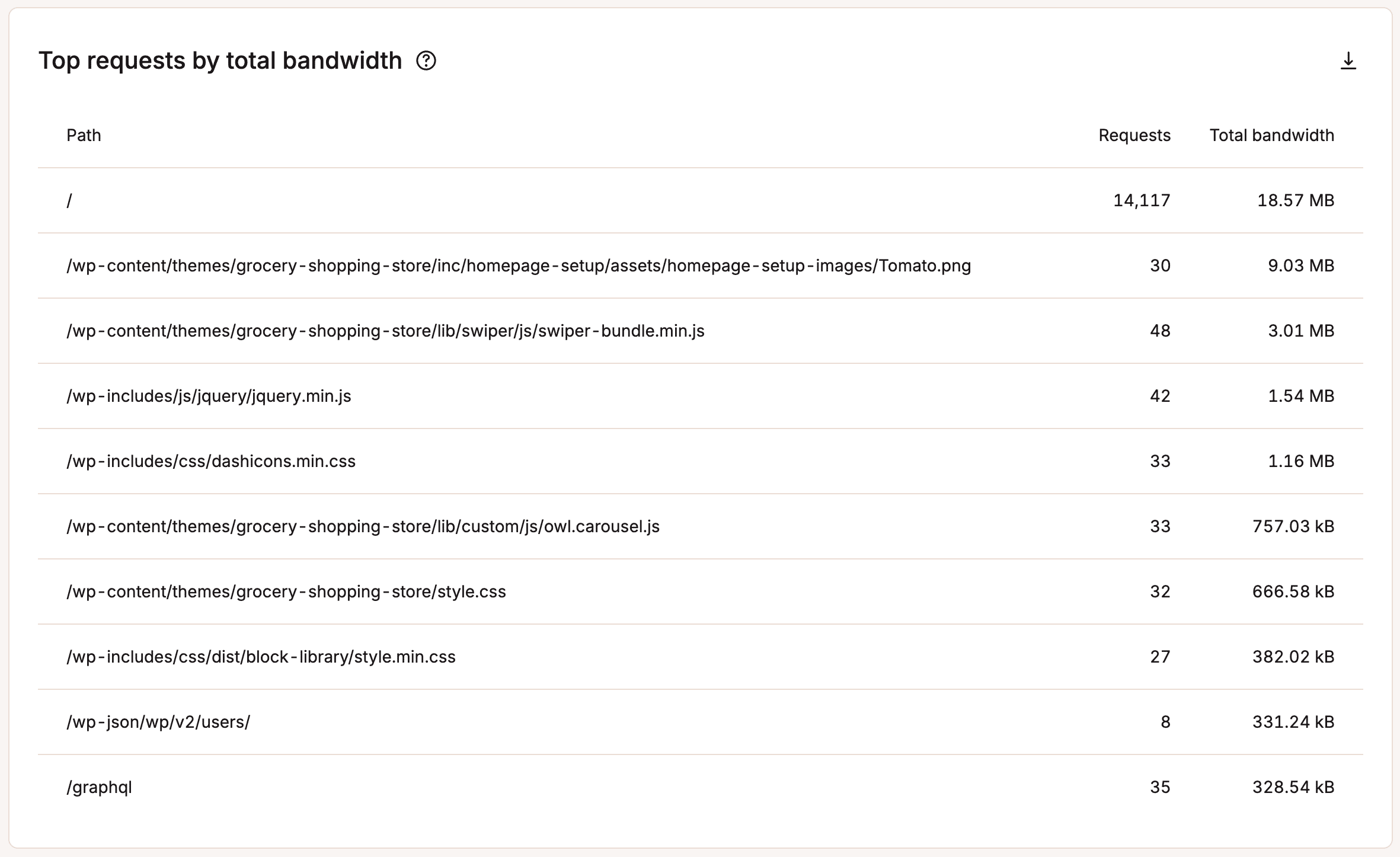

Met MyKinsta kun je in één oogopslag snel zien welke pagina’s het meeste verkeer krijgen:

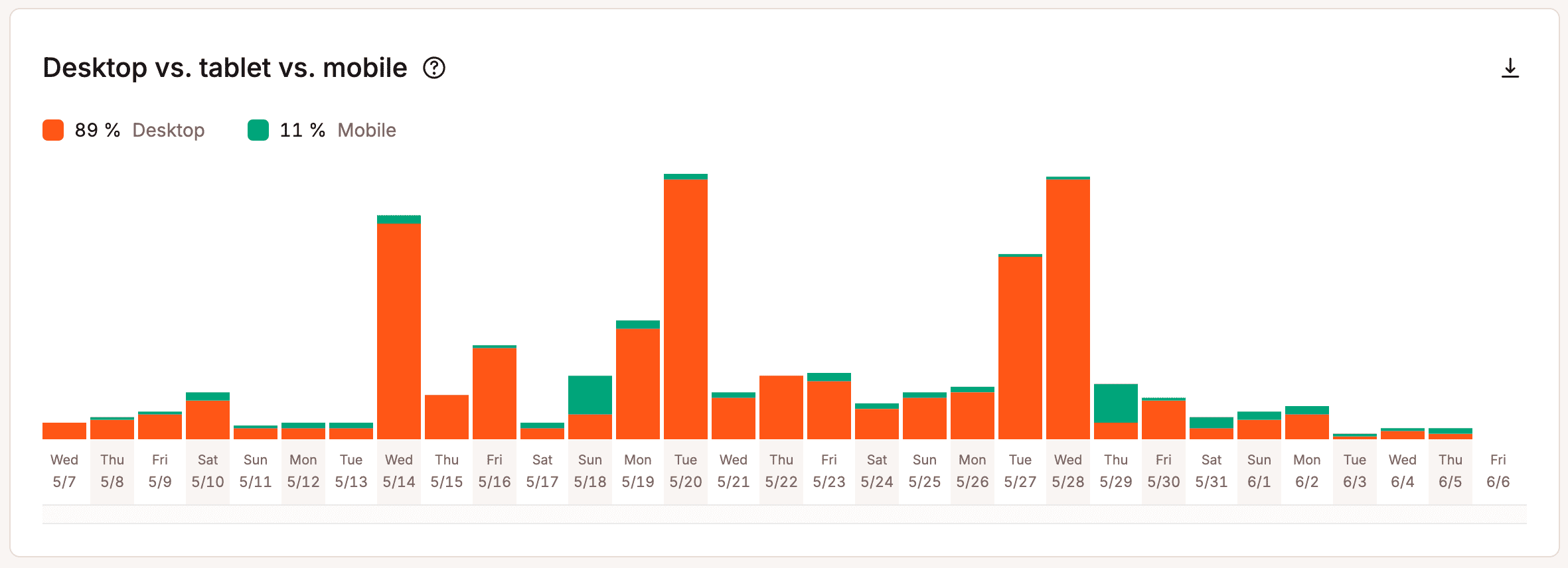

De diversiteit aan apparaten is een andere sterke indicator van menselijk verkeer. Echte bezoekers komen via een brede mix van browsers, besturingssystemen, verbindingssnelheden en schermformaten. Zelfs bij geografisch geconcentreerd verkeer zie je variatie in apparaten en configuraties, waardoor de verdeling zelden uniform is.

MyKinsta geeft ook informatie over het gebruik van apparaten:

Tegelijkertijd is het niet altijd eenvoudig om menselijk verkeer te identificeren. Privacybescherming, adblockers, cachinglagen en gedeelde netwerkomgevingen kunnen bepaalde signalen verdoezelen of ervoor zorgen dat verschillende gebruikers op infrastructuurniveau op elkaar lijken.

Om deze reden werkt verkeersclassificatie het beste wanneer meerdere indicatoren, waaronder de gedragspatronen, sessiekenmerken, apparaatdiversiteit en interactiesignalen waar we het over hadden, samen worden geëvalueerd in plaats van op één enkele statistiek te vertrouwen.

Nuttige bots: automatisering die je site ondersteunt

Niet al het geautomatiseerde verkeer wil je tegenhouden. Veel bots spelen een essentiële rol bij het zichtbaar houden, monitoren en correct functioneren van je website.

Crawlers van zoekmachines

Dit is een van de belangrijkste voorbeelden. Deze bots vragen systematisch pagina’s op om nieuwe content te ontdekken, wijzigingen te evalueren en zoekindexen bij te werken.

Hun gedrag is doorgaans gestructureerd en voorspelbaar: ze volgen links methodisch en houden zich aan de crawl-richtlijnen die in robots.txt zijn gedefinieerd. Als je deze crawlers de toegang tot je site ontzegt, kan dat je zichtbaarheid in zoekresultaten verminderen en ervoor zorgen dat nieuwe pagina’s minder snel in de resultaten verschijnen.

Uptime-monitors en testdiensten

Andere legitieme automatisering richt zich op monitoring en de operationele gezondheid. Uptime-monitoringtools, prestatiecontroles en synthetische testdiensten sturen regelmatig verzoeken om de beschikbaarheid te bevestigen, laadtijden te meten en storingen vroegtijdig op te sporen.

SEO- en validatietools

Op dezelfde manier scannen SEO-, toegankelijkheids- en validatietools pagina’s om technische problemen, gebroken links of nalevingskwesties op te sporen die anders onopgemerkt zouden blijven.

Nuttige bots maken hun aanwezigheid meestal duidelijk. Ze identificeren zichzelf vaak via consistente user-agentstrings, werken binnen gedefinieerde verzoeklimieten en volgen gepubliceerde crawlbeleidsregels.

Omdat deze systemen indexering, observatie en integraties ondersteunen, kan het blokkeren ervan zonder beoordeling monitoringworkflows verstoren, de vindbaarheid verminderen of diensten onderbreken die afhankelijk zijn van geplande geautomatiseerde verzoeken.

Schadelijke bots: verkeer dat risico’s of verspilling veroorzaakt

Schadelijke bots zijn geautomatiseerde systemen die zijn ontworpen om websites te misbruiken, op grote schaal gegevens te extraheren of infrastructuurbronnen te verbruiken zonder enige legitieme waarde te bieden. In tegenstelling tot nuttige automatisering proberen deze bots doorgaans hun identiteit te verbergen, crawlregels te negeren en verzoekpatronen te genereren die bedoeld zijn om basisbeveiligingen te omzeilen.

Credential-stuffing- en brute-force-bots

Dit zijn een paar van de meest voorkomende bedreigingen. Deze systemen richten zich herhaaldelijk op inlog-endpoints en testen in hoog tempo grote lijsten met gestolen gebruikersnamen en wachtwoorden in een poging om ongeoorloofde toegang te verkrijgen. Zelfs als ze niet slagen, kan het volume aan verzoeken de serverbelasting verhogen en de responstijden voor legitieme gebruikers vertragen.

Kwetsbaarheidsscanners en scrapers

Andere kwaadaardige automatisering richt zich op het opsporen en misbruiken van kwetsbaarheden. Kwetsbaarheidsscanners doorzoeken bekende mappen, configuratiebestanden en software-endpoints op zoek naar verouderde componenten of verkeerde configuraties die misbruikt kunnen worden. Agressieve scraping-bots kunnen ook grote hoeveelheden pagina’s of mediabestanden opvragen om inhoud te kopiëren en elders opnieuw te publiceren, waarbij ze bandbreedte en infrastructuurcapaciteit verbruiken.

DDoS-aanvallen

Sommige aanvallen zijn puur gericht op verstoring in plaats van toegang. Traffic-flooding- en denial-of-service-campagnes proberen servers of applicatielagen te overbelasten met aanhoudende pieken in het aantal verzoeken, waardoor de prestaties verslechteren of diensten tijdelijk onbeschikbaar worden.

Naast de directe impact op de prestaties kan schadelijk botverkeer de analytics verstoren en de ervaring voor echte bezoekers verslechteren als het niet wordt beheerd.

Hoe onderscheid je mensen, nuttige bots en schadelijke bots?

Het onderscheid tussen echte bezoekers, nuttige automatisering en schadelijke bots hangt minder af van één enkele identificatie en meer van het herkennen van consistente gedragspatronen in meerdere signalen.

Wanneer je deze indicatoren samen bekijkt, kun je makkelijker bepalen of het verkeer menselijke activiteit, legitieme automatisering of mogelijk misbruikende verzoeken weerspiegelt.

Frequentie en timing van verzoeken

Menselijke bezoekers genereren verzoeken met onregelmatige tussenpozen terwijl ze lezen, scrollen en navigeren, terwijl geautomatiseerde systemen de neiging hebben om pagina’s op te vragen met zeer consistente snelheden of in snelle bursts die voor een mens moeilijk te evenaren zijn. Extreem hoge verzoekfrequenties vanuit één bron of perfect getimede intervallen duiden meestal op gescripte activiteit.

User agent-strings

Legitieme bots identificeren zichzelf doorgaans duidelijk en consistent, terwijl schadelijke bots vaak van user agent wisselen of deze vervalsen in een poging om menselijk over te komen. Door user agent-verklaringen te vergelijken met waargenomen gedrag, kun je inconsistenties ontdekken die wijzen op automatisering.

IP-reputatie en netwerkeigendom

Verkeer afkomstig van bekende cloudhostingnetwerken, proxyservices of eerder gemarkeerde adressen kan wijzen op geautomatiseerde systemen in plaats van op echte mensen. Reputatiedatabases en beveiligingstools classificeren deze netwerken op basis van eerdere activiteiten en helpen verdachte bronnen sneller te identificeren.

Geografische verspreidingspatronen

Plotselinge pieken in het verkeer vanuit onverwachte regio’s, vooral in combinatie met identiek verzoekgedrag, kunnen wijzen op gecoördineerde botactiviteit in plaats van echte groei van je publiek.

Naleving van robots.txt en crawl-limieten

Als je dit opmerkt, is dat een sterke aanwijzing voor legitieme automatisering. Nuttige bots volgen over het algemeen gepubliceerde crawlbeleidsregels en werken binnen redelijke verzoeklimieten, terwijl schadelijke bots deze richtlijnen meestal negeren en doorgaan met het opvragen van beperkte paden of bestanden.

Omdat geen van deze signalen op zichzelf een volledig antwoord geeft, komt een effectieve classificatie voort uit het gezamenlijk analyseren van verschillende indicatoren. Na verloop van tijd geven deze gecombineerde patronen een betrouwbaar beeld van de vraag of inkomend verkeer afkomstig is van echte gebruikers, nuttige automatisering of activiteit die gefilterd of beperkt moet worden.

Waar botverkeer te analyseren

Om botactiviteit te begrijpen, heb je inzicht nodig in verschillende lagen van je hosting- en leveringsstack. Geen enkele tool geeft het volledige beeld weer, en daarom levert het combineren van analyses, logs en beveiligingsdashboards veel betrouwbaardere inzichten op. Laten we ze eens bekijken:

Analytics-platforms bieden een goed uitgangspunt

Verkeerspieken zonder bijbehorende interactie, plotselinge geografische afwijkingen of ongebruikelijke apparaatverdelingen duiden vaak op geautomatiseerde activiteit. Hoewel analysetools bots niet altijd nauwkeurig classificeren, helpen ze patronen te illustreren die aangeven dat er nader onderzoek nodig is. Zelfs eenvoudige plugins zoals Jetpack kunnen hierbij helpen.

Server- en toegangslogs bieden het meest gedetailleerde beeld van het verzoekgedrag

Logs onthullen de frequentie van verzoeken, responscodes, user agent strings, IP-adressen en bezochte paden, waardoor je herhaalde scanpatronen, pogingen tot inlogaanvallen of scrapinggedrag kunt identificeren die anders verborgen zouden blijven in geaggregeerde analysegegevens.

CDN-dashboards voegen nog een extra laag zichtbaarheid toe

CDN-dashboards tonen verkeerspatronen aan de rand van het netwerk voordat verzoeken je oorspronkelijke server bereiken. Deze dashboards brengen vaak pieken in het verkeer, regionale afwijkingen of herhaalde geautomatiseerde verzoeken aan het licht die stroomopwaarts worden gefilterd of in snelheid worden beperkt. Dit helpt je aanvallen veel eerder te detecteren dan anders het geval zou zijn.

Firewalls en WAF-tools bieden realtime inzicht

Met firewalls kun je in realtime zien welke verzoeken zijn geblokkeerd, in twijfel zijn getrokken of verdacht zijn. Door firewalllogs te bekijken, kun je zien welke verkeersbronnen beveiligingsregels activeren en of er aanpassingen nodig zijn om valse positieven te verminderen of de beveiliging aan te scherpen.

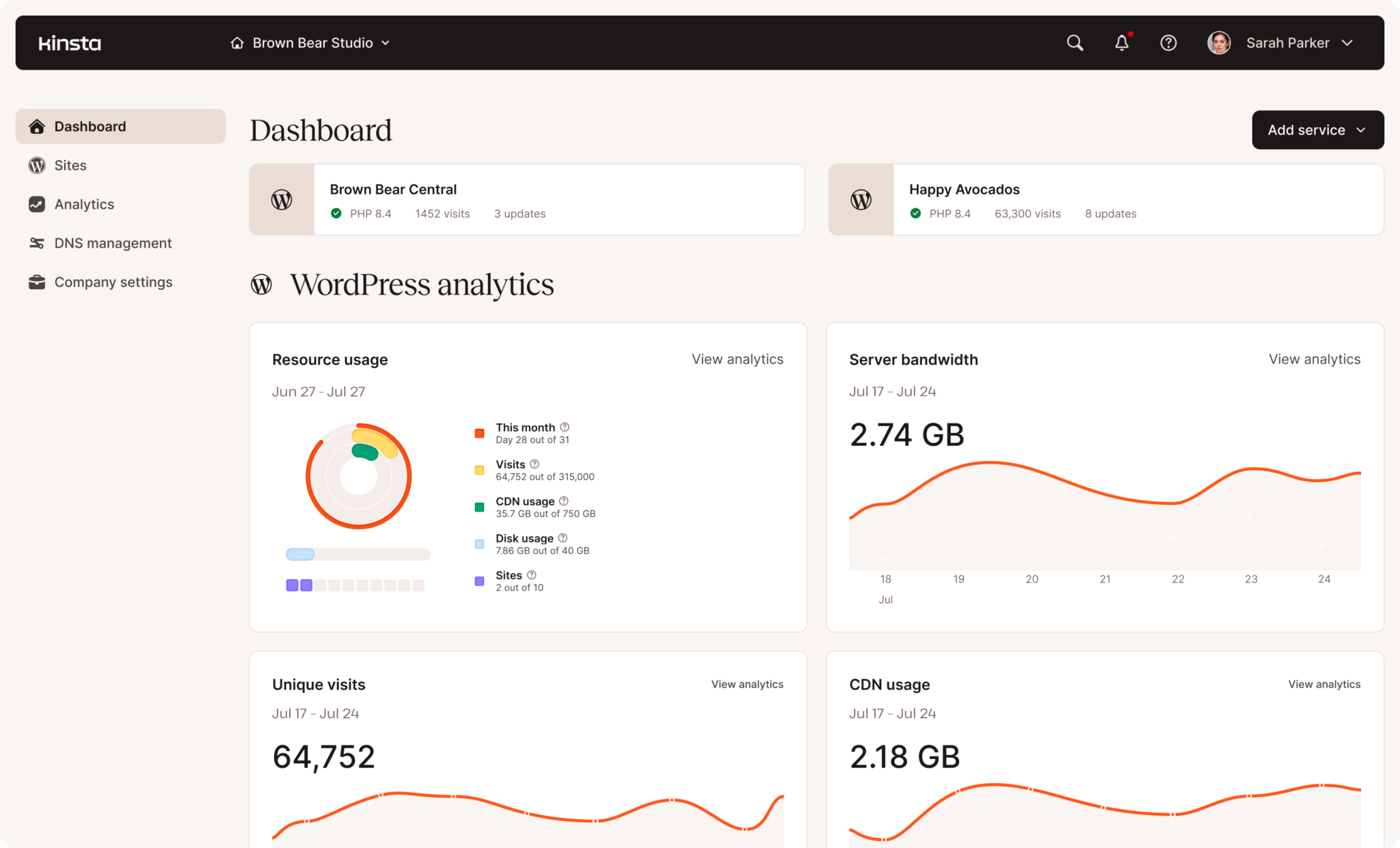

Managed hostingplatforms vereenvoudigen het proces door verschillende van deze gegevensbronnen samen te voegen. Omgevingen die bijvoorbeeld CDN-analyses, firewallmonitoring en toegangslogs integreren in één dashboard, maken het makkelijker om verdacht gedrag tussen verschillende lagen te correleren.

Hostingproviders zoals Kinsta brengen ook verkeersanalyses, prestatiemonitoring en gegevens over beveiligingsincidenten direct in hun dashboard, MyKinsta, onder de aandacht. Dit betekent dat jij en je team het gedrag van bots kunnen analyseren zonder afhankelijk te zijn van meerdere externe tools.

Hoe botverkeer analyses en besluitvorming vertekent

Wanneer geautomatiseerde verzoeken zich vermengen met legitieme bezoeken, gaan de analysegegevens activiteiten weergeven die niet de werkelijke interesse van het publiek weerspiegelen. Het aantal paginaweergaven en sessies lijkt misschien gestaag te stijgen, ook al blijven de daadwerkelijke betrokkenheid, conversies of inkomsten ongewijzigd. Zonder het geautomatiseerde verkeer te scheiden van menselijke sessies, kun je opgeblazen verkeerscijfers interpreteren als groei en strategische beslissingen nemen op basis van misleidende signalen.

Betrokkenheidsstatistieken worden bijzonder onbetrouwbaar. Bots genereren vaak sessies met extreem korte duur, onmiddellijke uitstapjes of herhaalde paginaverzoeken, wat de bouncepercentages en de tijd op de pagina kunstmatig kan verhogen of verlagen. In sommige gevallen vragen scraping-bots herhaaldelijk specifieke pagina’s op, waardoor het lijkt alsof bepaalde content veel beter presteert dan in werkelijkheid het geval is bij echte gebruikers.

Geografische, apparaat- en verwijzingsgegevens kunnen ook vertekend raken. Geautomatiseerd verkeer is vaak afkomstig van datacenters, proxynetwerken of geconcentreerde regio’s die niet overeenkomen met het daadwerkelijke klantenbestand van de site. Wanneer deze sessies in rapporten worden opgenomen, kunnen marketingteams in de verkeerde regio’s investeren, optimaliseren voor onjuiste apparaattrends of de campagneprestaties verkeerd interpreteren.

Na verloop van tijd beïnvloeden deze onnauwkeurigheden de rapportage, prestatieplanning, beslissingen over het opschalen van de infrastructuur en marketinginvesteringen. Al deze aspecten zijn afhankelijk van verkeersanalyses om de vraag te voorspellen. Als een aanzienlijk deel van dat verkeer bestaat uit geautomatiseerde verzoeken, lopen bedrijven het risico de groei te overschatten, middelen inefficiënt toe te wijzen of echt gebruikersgedrag over het hoofd te zien dat aandacht vereist.

Best practices voor het beheren van verschillende soorten verkeer

Het beheren van modern webverkeer vereist een evenwichtige aanpak die de prestaties van de site beschermt zonder legitieme automatisering of echte gebruikers te hinderen. In plaats van alles te blokkeren wat geautomatiseerd lijkt, is het doel om beleid toe te passen dat aansluit bij het gedrag en de intentie van elk type verkeer.

Geef prioriteit aan de echte gebruikerservaring

Optimaliseer de prestaties, beschikbaarheid en toegankelijkheid, zodat legitieme bezoekers snel en betrouwbaar toegang hebben tot de inhoud, zelfs tijdens pieken in het verkeer. Snelle laadtijden, een stabiele infrastructuur en veerkrachtige caching helpen ervoor te zorgen dat legitieme gebruikers geen hinder ondervinden wanneer het geautomatiseerde verkeer toeneemt. Je kunt de prestaties rechtstreeks binnen Kinsta optimaliseren door de Kinsta API te gebruiken in combinatie met Google PageSpeed Insights.

Sta nuttige automatisering toe en houd deze in de gaten

Crawlers van zoekmachines, uptime-monitors en validatietools moeten waar nodig expliciet worden toegestaan, zodat indexering, monitoring en integraties correct blijven functioneren. Door het crawlgedrag regelmatig te controleren, kun je bevestigen dat legitieme bots binnen redelijke grenzen opereren.

Pas op gedrag gebaseerde bescherming toe op schadelijk verkeer

Rate limits, beveiligingscontroles en gerichte blokkeringsregels werken het beste wanneer ze worden geactiveerd door verdachte verzoekpatronen in plaats van statische aannames over IP-bereiken of user agents. Gedragscontroles verminderen de kans dat legitieme diensten worden geblokkeerd, terwijl ze toch misbruik tegengaan.

Controleer en pas je beleid regelmatig aan

Verkeerspatronen veranderen naarmate sites groeien, campagnes worden gelanceerd en nieuwe geautomatiseerde systemen met content communiceren. Door firewallregels, snelheidslimieten en monitoringwaarschuwingen regelmatig te controleren, zorg je ervoor dat de beveiliging aansluit bij je huidige verkeersgedrag, in plaats van te vertrouwen op verouderde aannames.

Gebruik informatie over verkeersbronnen om betere beslissingen te nemen

Het verkeersvolume alleen vertelt zelden het volledige verhaal over hoe een website presteert. Wanneer menselijke bezoeken, nuttige automatisering en schadelijke botactiviteit van elkaar worden gescheiden, worden analytische gegevens veel betekenisvoller en bruikbaarder.

Door een zuivere segmentatie van het verkeer kunnen teams de echte groei van het publiek meten, echte betrokkenheidspatronen begrijpen en marketingprestaties evalueren zonder dat geautomatiseerde ruis de resultaten vertekent.

Een nauwkeurigere classificatie van het verkeer verbetert ook operationele beslissingen. Prestatieplanning, schaalbaarheid van de infrastructuur en beveiligingsstrategieën kunnen gemakkelijker worden afgestemd op de werkelijke vraag wanneer geautomatiseerde verzoeken onafhankelijk worden gemeten en beheerd.

Als je huidige hostingomgeving beperkt inzicht biedt in verkeersbronnen, is het misschien de moeite waard om platforms te evalueren die diepgaandere verkeersinformatie en geïntegreerde tools voor botbeheer bieden. Beheerde omgevingen zoals Kinsta bieden ingebouwde analytics, firewallbescherming en verkeersinzichten op edge-niveau die helpen om echte gebruikers te onderscheiden van geautomatiseerde activiteit.

De nieuwere, op bandbreedte gebaseerde hostingpakketten van Kinsta bieden ook meer flexibiliteit door hostingresources beter af te stemmen op het daadwerkelijke verkeersverbruik. Als je vragen hebt, kun je altijd contact opnemen met ons supportteam.