Aumentar el tráfico debería significar más éxito, pero en la práctica, a menudo no es así. Muchos sitios web ven cómo crece el número de visitas, mientras que las conversiones, la interacción y los ingresos se mantienen estancados, lo que hace que los equipos se pregunten por qué ese «crecimiento» no parece tal.

Una de las razones es que no todo el tráfico corresponde a personas reales. La actividad automatizada representa hoy en día una gran parte de la web moderna. De hecho, el Informe Imperva sobre bots maliciosos de 2025 (Imperva Bad Bot Report) reveló que los sistemas automatizados representaban el 51 % de todo el tráfico web en 2024, lo que significa que, por primera vez en una década, los bots generaron en conjunto más solicitudes que los visitantes humanos.

Cuando el tráfico automatizado se mezcla en los informes analíticos, el simple recuento de visitas deja de ser una medida fiable del interés o la demanda reales de la audiencia.

Este artículo explica cómo distinguir entre visitantes reales del sitio, automatización útil y actividad dañina de bots.

¿Qué es realmente el tráfico de bots?

El tráfico de bots se refiere a las solicitudes realizadas por software automatizado en lugar de por un humano que utiliza un navegador. Estos programas envían solicitudes a páginas web, imágenes, scripts o APIs de la misma manera que lo haría el navegador de un visitante, pero la actividad ocurre sin interacción humana directa.

Desde un punto de vista técnico, el servidor suele ver el mismo tipo de solicitud. La diferencia radica en cómo se genera la solicitud y cómo se comporta a lo largo del tiempo.

La automatización no es algo inusual ni intrínsecamente dañina. Gran parte de Internet depende de sistemas automatizados que rastrean continuamente sitios web, comprueban el tiempo de actividad, validan el rendimiento o recuperan datos para servicios legítimos. Los motores de búsqueda dependen de los bots para descubrir e indexar contenido nuevo, las herramientas de monitorización comprueban regularmente la disponibilidad y diversas integraciones consultan las APIs para mantener las aplicaciones sincronizadas.

Es importante destacar que la palabra «bot» describe cómo se genera el tráfico, no por qué existe. Algunos sistemas automatizados favorecen la visibilidad y la seguridad, mientras que otros intentan explotar vulnerabilidades, extraer contenido o saturar la infraestructura. Dado que las intenciones varían mucho, identificar y clasificar el comportamiento de los bots es mucho más útil que tratar todo el tráfico automatizado como una sola categoría.

Los tres tipos de tráfico que llegan a tu sitio

A menudo se habla del tráfico web como una simple división entre «humanos» y «bots», pero en realidad, la mayoría de las solicitudes se dividen en tres categorías prácticas: visitantes reales, bots útiles y bots dañinos. Entender esta distinción facilita la interpretación de los datos analíticos, la gestión de los recursos y la aplicación de los controles de seguridad adecuados sin interrumpir la actividad legítima.

Como mencionamos antes, el informe Imperva Bad Bot Report señaló que el tráfico automatizado representaba más de la mitad de todas las solicitudes web a nivel mundial, y que una parte considerable clasificada tanto como automatización beneficiosa como actividad maliciosa de bots. Cuando se combinan estas diferentes fuentes, el volumen de tráfico por sí solo ofrece poca información sobre la demanda real de los usuarios o su interacción.

El objetivo no es bloquear todo lo que parezca automatizado, sino identificar qué solicitudes provienen de personas reales, cuáles respaldan la funcionalidad y la visibilidad del sitio, y cuáles generan riesgos o una carga innecesaria.

Analizar los patrones de comportamiento, las características de las solicitudes y las fuentes de tráfico puede proporcionarte la claridad necesaria para implementar una automatización útil, protegerte contra actividades maliciosas y evaluar el rendimiento utilizando datos que reflejen el comportamiento real de los usuarios.

Visitantes reales: cómo es el tráfico humano

El tráfico humano tiende a seguir patrones irregulares e impredecibles. Los visitantes reales se mueven por los sitios de formas muy variadas. Hacen clic en diferentes rutas de navegación, se detienen en ciertas páginas, se desplazan a diferentes profundidades y pasan cantidades de tiempo variables antes de realizar la siguiente acción. Incluso cuando llegan varios visitantes procedentes de la misma campaña o región, su comportamiento rara vez sigue secuencias idénticas.

Las sesiones de usuario auténticas también incluyen patrones de interacción realistas. Acciones como las búsquedas en el sitio, el envío de formularios, la reproducción de archivos multimedia, los inicios de sesión en cuentas o la actividad de comercio electrónico suelen producirse en secuencias lógicas, en lugar de en intervalos perfectamente sincronizados o repetidos. El intervalo entre las solicitudes varía de forma natural, reflejando cómo leen, piensan y deciden qué hacer a continuación las personas.

Con MyKinsta, puedes ver rápidamente qué páginas reciben más tráfico, de un solo vistazo:

La diversidad de dispositivos es otro indicador claro del tráfico humano. Los visitantes reales llegan utilizando una amplia variedad de navegadores, sistemas operativos, velocidades de conexión y tamaños de pantalla. Incluso el tráfico geográfico concentrado muestra variaciones entre dispositivos y configuraciones, creando una distribución que rara vez parece uniforme.

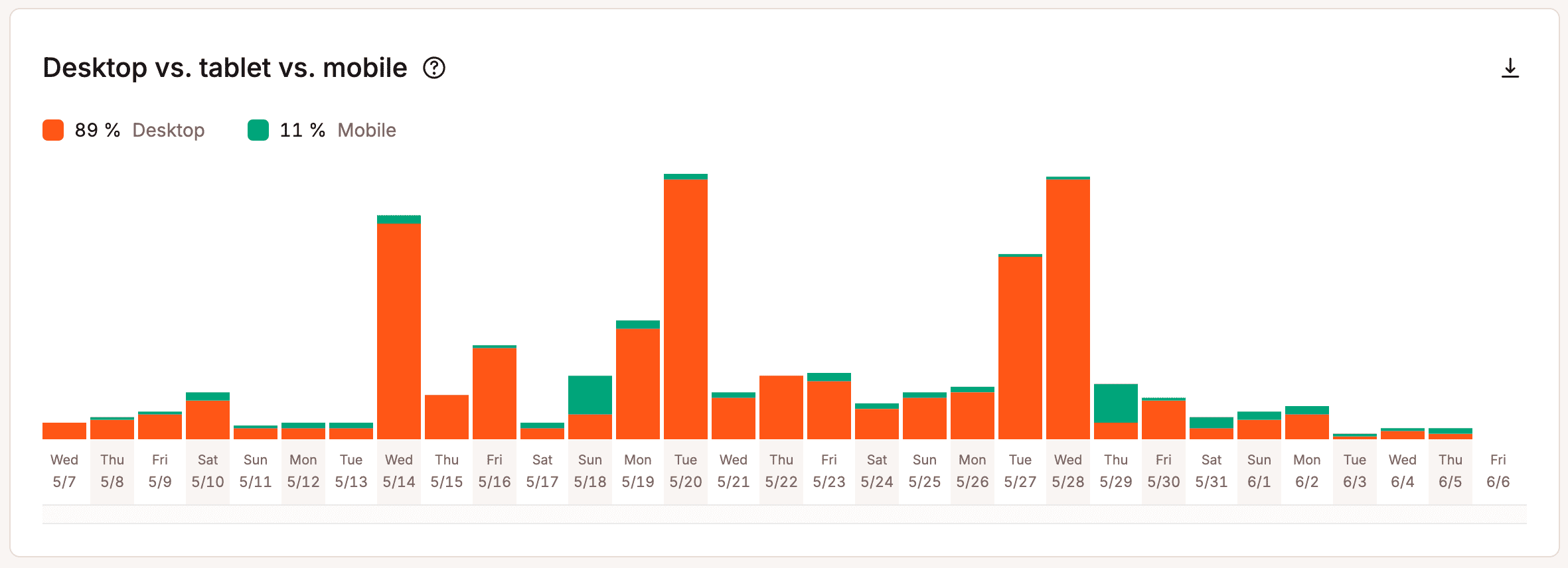

MyKinsta también proporciona información sobre el uso de dispositivos:

Al mismo tiempo, identificar el tráfico humano no siempre es sencillo. Las protecciones de privacidad, los bloqueadores de anuncios, las capas de caché y los entornos de red compartidos pueden ocultar ciertas señales o hacer que diferentes usuarios parezcan similares a nivel de infraestructura.

Por eso, la clasificación del tráfico funciona mejor cuando se evalúan conjuntamente varios indicadores, como los patrones de comportamiento, las características de las sesiones, la diversidad de dispositivos y las señales de interacción de las que hemos hablado, en lugar de basarse únicamente en una sola métrica.

Bots útiles: automatización que ayuda a tu sitio

No hay que bloquear todo el tráfico automatizado. Muchos bots desempeñan un papel esencial para que tu sitio web siga siendo visible, esté monitorizado y funcione correctamente.

Rastreadores de motores de búsqueda

Este es uno de los ejemplos más importantes. Estos bots solicitan páginas de forma sistemática para descubrir contenido nuevo, evaluar cambios y actualizar los índices de búsqueda.

Su comportamiento suele ser estructurado y predecible, siguiendo enlaces metódicamente y respetando las directivas de rastreo definidas en el archivo robots.txt. Impedir que estos rastreadores accedan a tu sitio puede reducir la visibilidad en las búsquedas y retrasar la rapidez con la que aparecen las páginas nuevas en los resultados.

Servicios de monitorización y pruebas de disponibilidad

Otras automatizaciones legítimas se centran en la monitorización y el estado operativo. Las herramientas de monitorización del tiempo de actividad, los verificadores de rendimiento y los servicios de pruebas sintéticas envían solicitudes a intervalos regulares para confirmar la disponibilidad, medir los tiempos de carga y detectar fallos de forma temprana.

Herramientas de SEO y validación

Del mismo modo, las herramientas de SEO, accesibilidad y validación analizan las páginas para identificar problemas técnicos, enlaces rotos o cuestiones de cumplimiento que, de otro modo, podrían pasar desapercibidos.

Los bots útiles suelen dejar clara su presencia. A menudo se identifican mediante cadenas de agente de usuario coherentes, operan dentro de los límites de solicitud establecidos y siguen las políticas de rastreo publicadas.

Ya que estos sistemas soportan la indexación, la observabilidad y las integraciones, bloquearlos sin una revisión previa puede interrumpir los flujos de trabajo de monitorización, reducir la visibilidad o provocar fallos en los servicios que dependen de solicitudes automatizadas programadas.

Bots dañinos: tráfico que supone un riesgo o un desperdicio

Los bots dañinos son sistemas automatizados diseñados para explotar sitios web, extraer datos a gran escala o consumir recursos de infraestructura sin aportar ningún valor legítimo. A diferencia de la automatización útil, estos bots suelen intentar ocultar su identidad, ignorar las reglas de rastreo y generar patrones de solicitud destinados a eludir las protecciones básicas.

Bots de relleno de credenciales y de fuerza bruta

Estas son algunas de las amenazas más comunes. Estos sistemas atacan repetidamente los puntos de acceso de inicio de sesión, probando grandes listas de nombres de usuario y contraseñas robados en rápida sucesión para intentar obtener acceso no autorizado. Incluso cuando no tienen éxito, el volumen de solicitudes puede aumentar la carga del servidor y ralentizar los tiempos de respuesta para los usuarios legítimos.

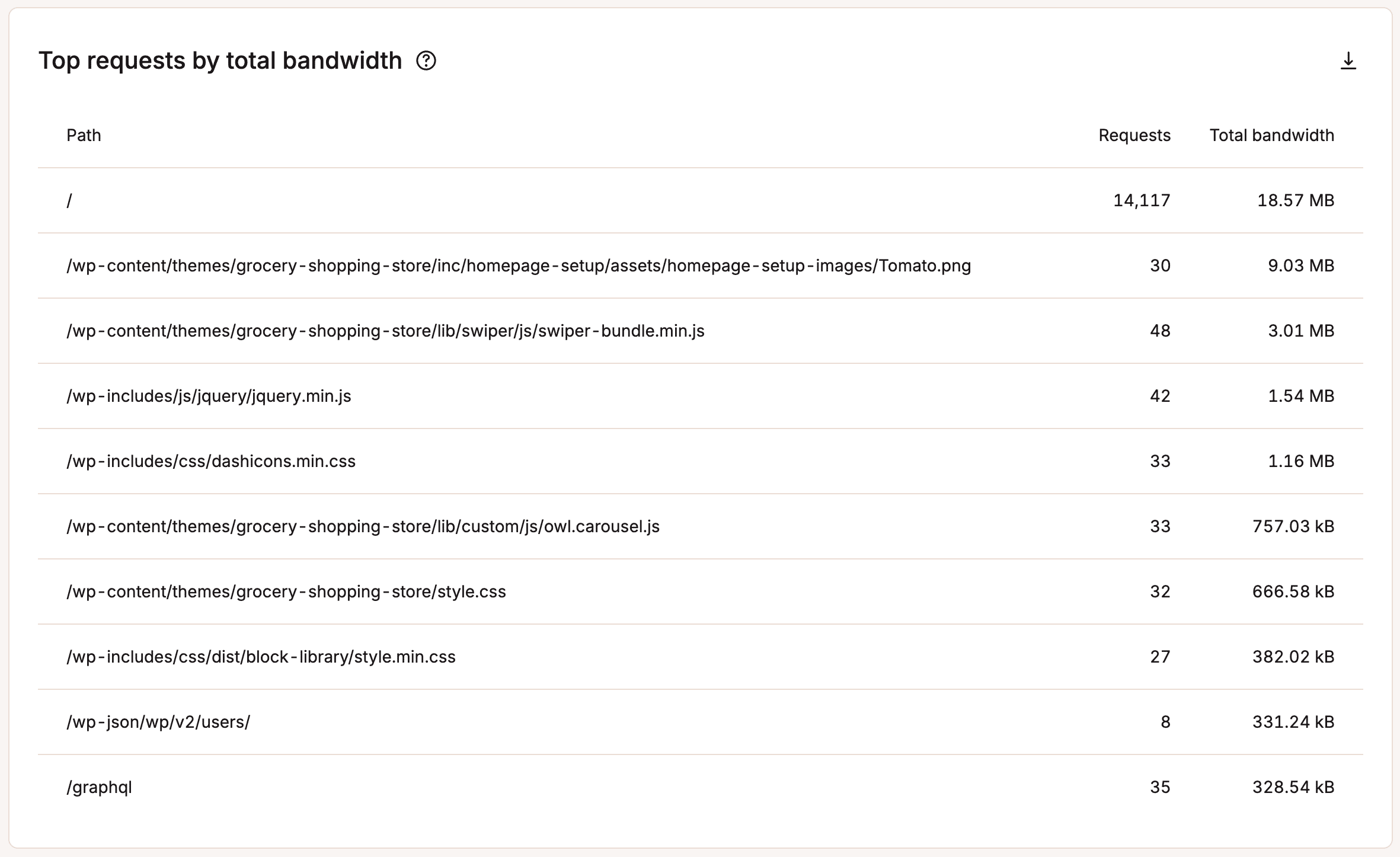

Escáneres de vulnerabilidades y rastreadores

Otros tipos de automatización maliciosa se centran en el descubrimiento y la explotación. Los escáneres de vulnerabilidades analizan directorios conocidos, archivos de configuración y puntos de acceso de software para buscar componentes obsoletos o configuraciones erróneas que puedan ser explotadas. Los bots de scraping agresivos también pueden solicitar grandes volúmenes de páginas o archivos multimedia para copiar contenido y volver a publicarlo en otros sitios, consumiendo ancho de banda y capacidad de infraestructura en el proceso.

Ataques DDoS

Algunos ataques tienen como único objetivo causar interrupciones, más que obtener acceso. Las campañas de saturación de tráfico y de denegación de servicio intentan colapsar los servidores o las capas de aplicación con picos continuos de solicitudes, lo que reduce el rendimiento o hace que los servicios dejen de estar disponibles temporalmente.

Más allá de su impacto inmediato en el rendimiento, el tráfico de bots maliciosos puede distorsionar los datos analíticos y empeorar la experiencia de los visitantes reales si no se controla.

Cómo distinguir entre humanos, bots útiles y bots dañinos

Distinguir entre visitantes reales, automatizaciones útiles y bots dañinos no depende tanto de un único identificador, sino más bien de reconocer patrones de comportamiento consistentes a través de múltiples señales.

Si se analizan en conjunto, estos indicadores facilitan determinar si el tráfico se debe a actividad humana, a automatización legítima o a solicitudes potencialmente abusivas.

Frecuencia y momento de las solicitudes

Los visitantes humanos generan solicitudes a intervalos irregulares mientras leen, se desplazan y navegan, mientras que los sistemas automatizados tienden a solicitar páginas a velocidades muy constantes o en ráfagas rápidas que serían difíciles de imitar para una persona. Las tasas de solicitud extremadamente altas procedentes de una sola fuente o los intervalos perfectamente sincronizados suelen indicar actividad programada.

Cadenas de agente de usuario

Los bots legítimos suelen identificarse de forma clara y coherente, mientras que los bots maliciosos suelen rotar o suplantar los agentes de usuario para intentar parecer humanos. Comparar las declaraciones de los agentes de usuario con el comportamiento observado ayuda a revelar inconsistencias que indican que hay automatización.

Reputación de IP y propiedad de la red

El tráfico procedente de redes de alojamiento en la nube conocidas, servicios de proxy o direcciones previamente marcadas puede indicar sistemas automatizados en lugar de personas reales. Las bases de datos de reputación y las herramientas de seguridad clasifican estas redes en función de su actividad pasada y ayudan a identificar fuentes sospechosas más rápidamente.

Patrones de distribución geográfica

Los aumentos repentinos de tráfico procedentes de regiones inesperadas, especialmente cuando se combinan con un comportamiento de solicitud idéntico, pueden sugerir una actividad coordinada de bots en lugar de un crecimiento genuino de la audiencia.

Respeto por el archivo robots.txt y los límites de rastreo

Si observas esto, es un claro indicador de automatización legítima. Los bots útiles suelen seguir las políticas de rastreo publicadas y operan dentro de límites de solicitud razonables, mientras que los bots dañinos suelen ignorar estas directrices y siguen solicitando rutas o archivos restringidos.

Dado que ninguna de estas señales por sí sola ofrece una respuesta completa, una clasificación eficaz se consigue analizando varios indicadores a la vez. Con el tiempo, estos patrones combinados ofrecen una visión fiable de si el tráfico entrante corresponde a usuarios reales, a automatización beneficiosa o a actividad que requiere filtrado o mitigación.

Dónde analizar el tráfico de bots

Para comprender la actividad de los bots, necesitas visibilidad en varias capas de tu stack de alojamiento y distribución. Ninguna herramienta por sí sola ofrece una visión completa, por lo que combinar analíticas, registros y paneles de seguridad te proporciona información mucho más fiable. Veamos cada uno de ellos:

Las plataformas de analítica ofrecen un punto de partida de gran valor

Los picos de tráfico sin una interacción equivalente, las anomalías geográficas repentinas o las distribuciones inusuales de dispositivos suelen indicar actividad automatizada. Aunque las herramientas de analítica no siempre clasifican a los bots con precisión, ayudan a identificar patrones que indican la necesidad de una investigación más profunda. Incluso plugins sencillos como Jetpack pueden ser de ayuda en este sentido.

Los registros del servidor y de acceso ofrecen la visión más detallada del comportamiento de las solicitudes

Los registros muestran la frecuencia de las solicitudes, los códigos de respuesta, las cadenas de agente de usuario, las direcciones IP y las rutas a las que se ha accedido, lo que te permite identificar patrones de escaneo repetitivos, intentos de ataque de inicio de sesión o comportamientos de scraping que, de otro modo, pasarían desapercibidos en los datos analíticos, que se agrupan todos juntos.

Los paneles de control de CDN añaden otra capa de visibilidad

Los paneles de control de CDN muestran los patrones de tráfico en el edge de la red antes de que las solicitudes lleguen a tu servidor de origen. Estos paneles suelen destacar picos de tráfico, anomalías regionales o solicitudes automatizadas repetidas que se filtran o se limitan en el flujo ascendente. Esto te ayuda a detectar ataques mucho antes de lo que lo harías de otra manera.

Los cortafuegos y las herramientas WAF proporcionan información en tiempo real

Los cortafuegos te permiten conocer en tiempo real las solicitudes bloqueadas, cuestionadas o sospechosas. Al revisar los registros del cortafuegos, puedes averiguar qué fuentes de tráfico están activando las reglas de seguridad y si es necesario hacer ajustes para reducir los falsos positivos o reforzar las protecciones.

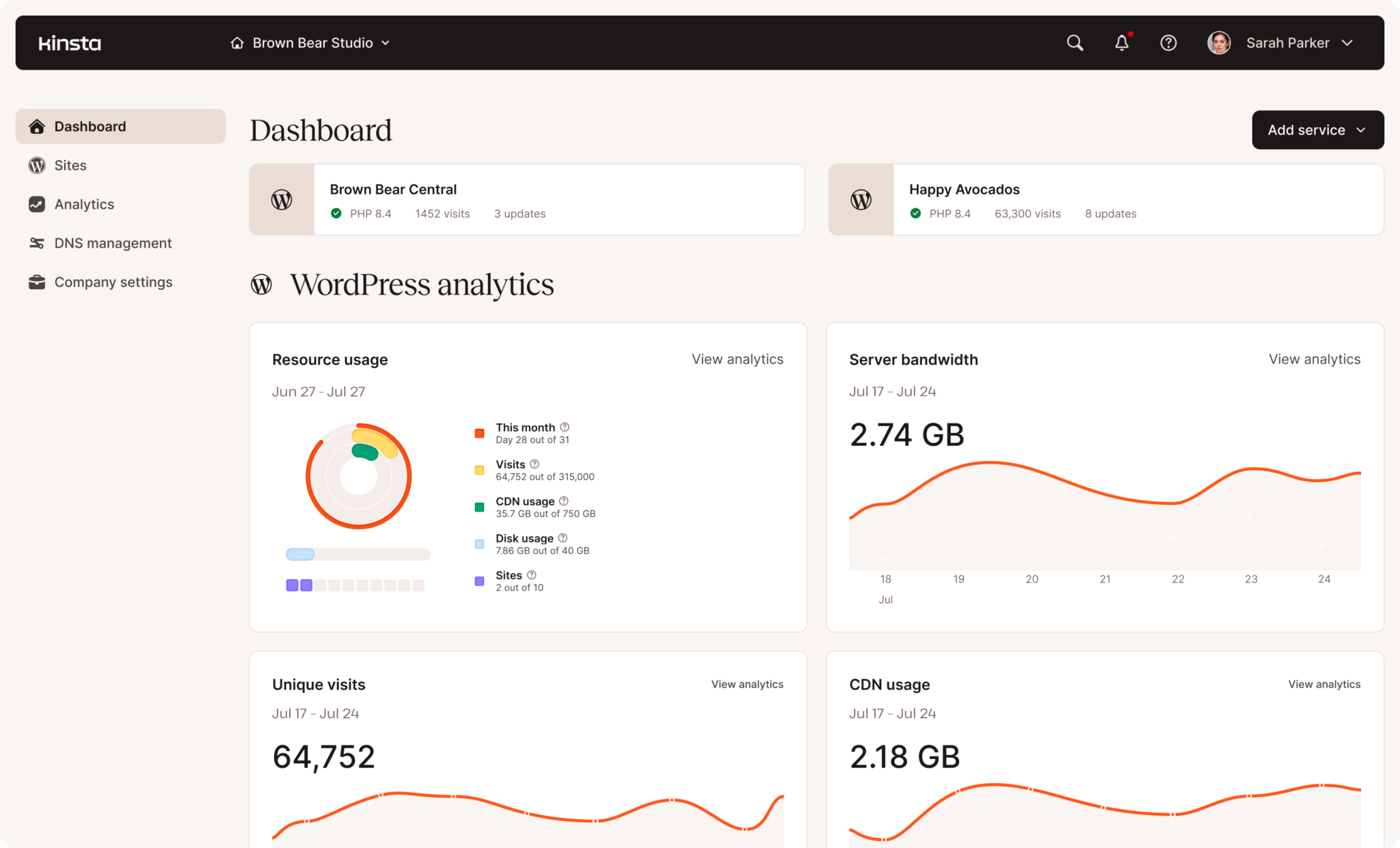

Las plataformas de alojamiento administrado simplifican el proceso al consolidar varias de estas fuentes de datos. Por ejemplo, los entornos que integran analíticas a nivel de CDN, monitorización de cortafuegos y registros de acceso en un único panel de control facilitan la correlación de comportamientos sospechosos entre las distintas capas.

Los proveedores de alojamiento como Kinsta también integran las analíticas de tráfico, la monitorización del rendimiento y los datos de incidentes de seguridad directamente en su panel de control, MyKinsta. Esto significa que tú y tu equipo podéis analizar el comportamiento de los bots sin tener que recurrir a múltiples herramientas externas.

Cómo el tráfico de bots distorsiona las analíticas y la toma de decisiones

Cuando las solicitudes automatizadas se mezclan con visitas legítimas, los datos analíticos comienzan a reflejar una actividad que no representa el interés real de la audiencia. Las visitas a la página y el recuento de sesiones pueden parecer que aumentan de forma constante, aunque la interacción real, las conversiones o los ingresos se mantengan sin cambios. Si no separas el tráfico automatizado de las sesiones humanas, puedes interpretar las cifras infladas de tráfico como crecimiento y tomar decisiones estratégicas basadas en señales engañosas.

Las métricas de interacción se vuelven especialmente poco fiables. Los bots suelen generar sesiones de duración extremadamente corta, salidas inmediatas o solicitudes repetidas de páginas, lo que puede aumentar o disminuir artificialmente la tasa de rebote y el tiempo de permanencia en la página. En algunos casos, los bots de rastreo solicitan repetidamente páginas específicas, creando la apariencia de que cierto contenido funciona mucho mejor de lo que realmente lo hace entre los usuarios reales.

Los datos geográficos, de dispositivos y de referencias también pueden verse distorsionados. El tráfico automatizado suele provenir de centros de datos, redes de proxy o regiones concentradas que no se corresponden con la base de clientes real del sitio. Cuando estas sesiones se incluyen en los informes, los equipos de marketing pueden invertir en las regiones equivocadas, optimizar en función de tendencias de dispositivos incorrectas o malinterpretar el rendimiento de las campañas.

Con el tiempo, estas imprecisiones afectan a los informes, a la planificación del rendimiento, a las decisiones sobre el escalado de la infraestructura y a las inversiones en marketing. Todos estos aspectos dependen de las analíticas del tráfico para predecir la demanda. Si una parte importante de ese tráfico está formada por solicitudes automatizadas, las empresas corren el riesgo de sobreestimar el crecimiento, asignar los recursos de forma ineficiente o pasar por alto el comportamiento real de los usuarios que requiere atención.

Prácticas recomendadas para gestionar diferentes tipos de tráfico

Gestionar el tráfico web moderno requiere un enfoque equilibrado que proteja el rendimiento del sitio sin interferir con la automatización legítima ni con los usuarios reales. En lugar de intentar bloquear todo lo que parezca automatizado, el objetivo es aplicar políticas que se ajusten al comportamiento y la intención de cada tipo de tráfico.

Prioriza la experiencia del usuario real

Optimiza el rendimiento, la disponibilidad y la accesibilidad para que los visitantes legítimos puedan acceder al contenido de forma rápida y fiable, incluso durante los picos de tráfico. Los tiempos de carga rápidos, una infraestructura estable y un almacenamiento en caché resistente ayudan a garantizar que los usuarios legítimos no se vean afectados cuando aumenta el tráfico automatizado. Puedes optimizar el rendimiento directamente en Kinsta utilizando la API de Kinsta con Google PageSpeed Insights.

Permite y monitoriza la automatización útil

Los rastreadores de motores de búsqueda, los monitores de tiempo de actividad y las herramientas de validación deben permitirse explícitamente cuando sea necesario, para que la indexación, la monitorización y las integraciones sigan funcionando correctamente. Revisar periódicamente el comportamiento de rastreo ayuda a confirmar que los bots legítimos operan dentro de límites razonables.

Aplica medidas de protección basadas en el comportamiento al tráfico malicioso

Los límites de velocidad, los retos de seguridad y las reglas de bloqueo selectivo funcionan mejor cuando se activan a partir de patrones de solicitud sospechosos, en lugar de basarse en suposiciones estáticas sobre rangos de IP o agentes de usuario. Los controles de comportamiento reducen la probabilidad de bloquear servicios legítimos, al tiempo que siguen mitigando las actividades abusivas.

Revisa y ajusta las políticas con regularidad

Los patrones de tráfico cambian a medida que los sitios crecen, se lanzan campañas y nuevos sistemas automatizados interactúan con el contenido. Las revisiones periódicas de las reglas del cortafuegos, los límites de velocidad y las alertas de monitorización ayudan a garantizar que las protecciones se adapten a tu comportamiento de tráfico actual, en lugar de basarse en suposiciones obsoletas.

Utiliza la información sobre el origen del tráfico para tomar mejores decisiones

El volumen de tráfico por sí solo rara vez cuenta toda la historia del rendimiento de un sitio web. Cuando se separan las visitas humanas, la automatización útil y la actividad dañina de los bots, los datos analíticos se vuelven mucho más significativos y aprovechables.

Una segmentación clara del tráfico permite a los equipos medir el crecimiento real de la audiencia, comprender los patrones de interacción reales y evaluar el rendimiento del marketing sin que el ruido automatizado distorsione los resultados.

Una clasificación del tráfico más precisa también mejora las decisiones operativas. La planificación del rendimiento, el escalado de la infraestructura y las estrategias de seguridad se alinean más fácilmente con la demanda real cuando las solicitudes automatizadas se miden y gestionan de forma independiente.

Si tu entorno de alojamiento actual ofrece una visibilidad limitada de las fuentes de tráfico, puede que valga la pena evaluar plataformas que ofrezcan una inteligencia de tráfico más profunda y herramientas integradas de gestión de bots. Los entornos administrados como Kinsta proporcionan analíticas integradas, protecciones de cortafuegos e información sobre el tráfico a nivel edge que ayudan a distinguir a los usuarios reales de la actividad automatizada.

Los nuevos planes de alojamiento basados en ancho de banda de Kinsta también añaden flexibilidad al ajustar mejor los recursos de alojamiento al consumo real de tráfico. Si tienes alguna pregunta, puedes hablar con nuestro equipo de soporte en cualquier momento.